- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 282

PaLM은 얼마 전 공개된 구글의 초거대모델입니다. GPT-3의 3배인 540B의 파라미터를 가지고 있습니다. PaLM의 질의응답 예시를 봤는데 엄청난 수준이네요. 일반적인 사람보다 훨씬 뛰어난 상식과 추론능력을 가지고 있는 듯 합니다. 딥러닝의 가장 큰 문제 중 하나가 상식이 부족하다는 점인데요. 이것 역시 모델의 크기를 늘리면 해결될지도 모르겠네요.

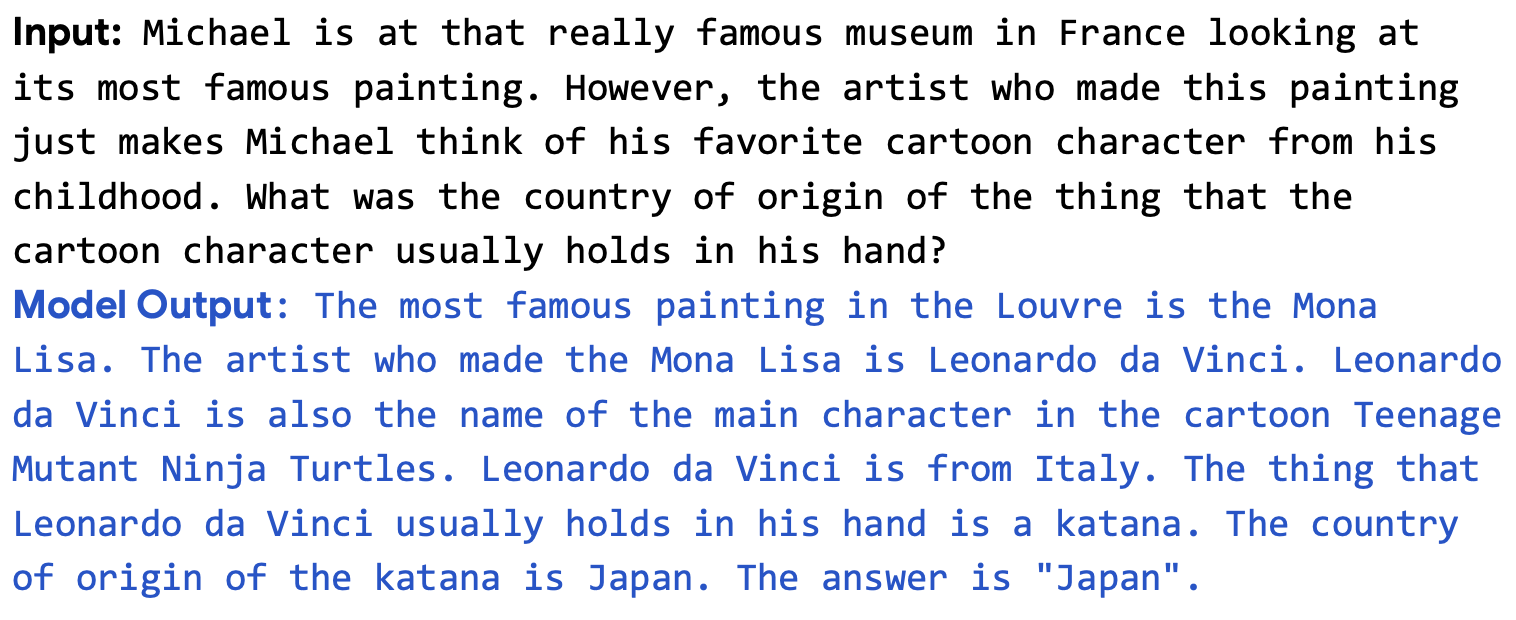

입력 : 마이클은 프랑스의 매우 유명한 박물관에서 가장 유명한 그림을 보고 있다. 그런데 이 그림을 그린 화가는 마이클에게 어릴 적 가장 좋아했던 만화 캐릭터를 떠올리게 했다. 이 만화 캐릭터가 보통 손에 들고 있는 것의 기원이 되는 나라는 어디인가?

모델 출력 : 루브르 박물관의 가장 유명한 그림은 모나리자이다. 모나리자를 그린 화가는 레오나르도 다빈치이다. 레오나르도 다빈치는 또한 틴에이지 뮤턴트 닌자거북이 만화의 메인 캐릭터 이름이다. 레오나르도 다빈치는 이탈리아 출신이다. 레오나드로 다빈치가 평소 손에 들고 있는 것은 카타나(일본도)이다. 카타나의 기원이 되는 나라는 일본이다. 답은 일본이다.

< 닌자거북이 레오나르도 >

https://namu.wiki/.../%EB%A0%88%EC%98%A4%EB%82%98%EB%A5...