- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 282

https://brunch.co.kr/@kakao-it/243

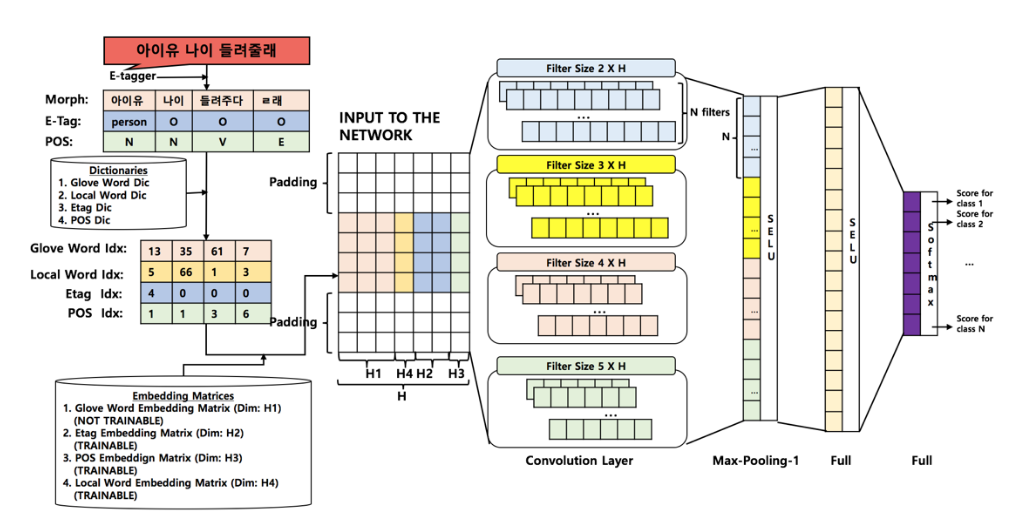

카카오미니에서는 문장의 의미를 두 가지 단계로 판단합니다. 첫 번째는 음악, 라디오, 뉴스 등 어떤 주제의 봇인지 결정합니다. 두 번째는 무슨 작업을 원하는지 의도를 파악합니다. 같은 문장이라도 주제에 따라 다른 명령을 나타내기 때문입니다.

단순히 키워드 매칭으로 하면 문장의 순서나 문맥이 다르면 정확하기 의미를 분류하기가 어렵습니다. 그래서 카카오미니에서는 딥러닝의 기법인 CNN을 사용해서 이런 작업을 처리하였다고 합니다.