- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

https://tv.naver.com/v/11212753

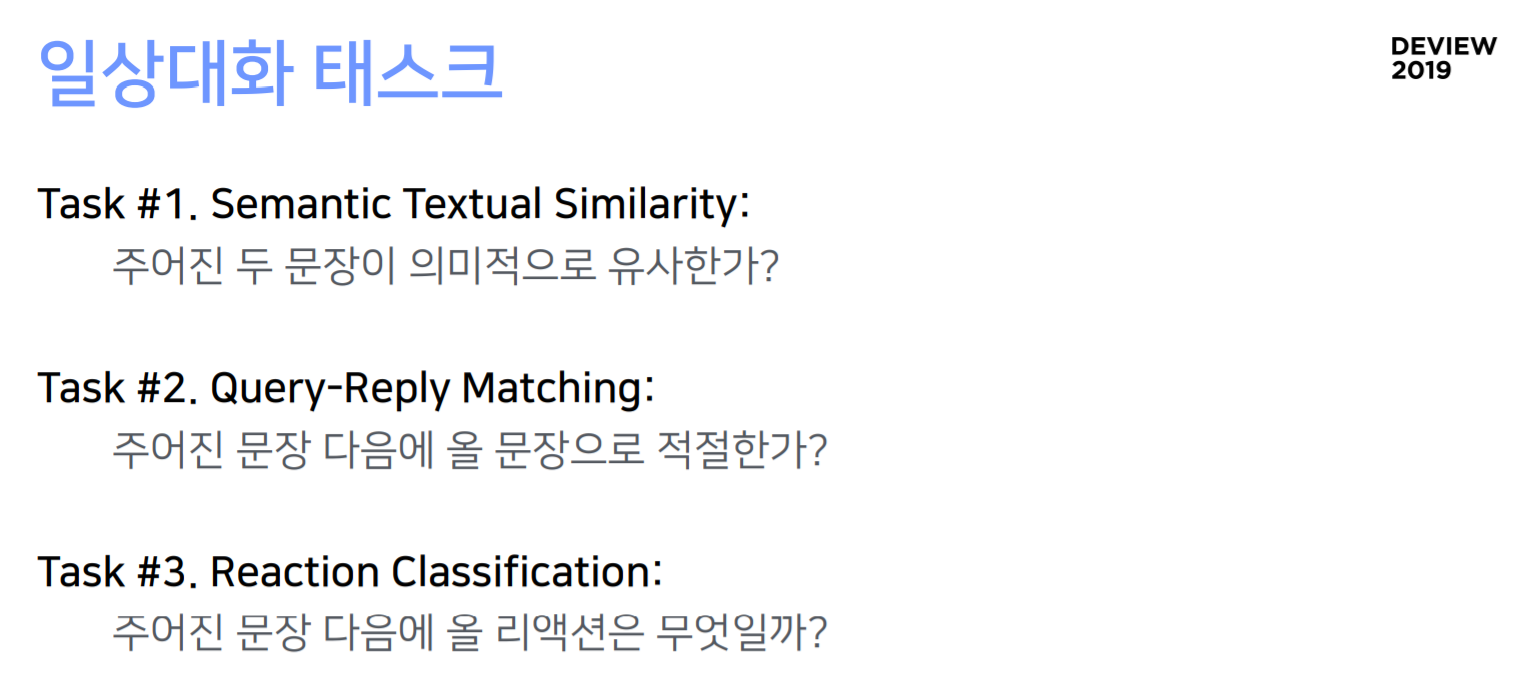

작년 DEVIEW 2019에서 스캐터랩 핑퐁팀이 발표한 내용입니다. Dialog-BERT를 사용한 일상대화 모델에 대해 소개하고 있습니다. 자사의 다른 앱에서 비식별화한 카톡 데이터를 수집하여 학습을 했다고 합니다. 다음과 같이 3가지의 방법으로 구성되어 있습니다.

첫째, 리액션입니다. 입력 문장을 1000개 정도의 클래스로 분류하고 거기에 맞는 대답을 출력합니다. 정확하고 구체적인 답변은 어렵지만, 어떠한 질문에도 그럴듯하게 대응할 수 있다는 장점이 있습니다.

둘째, 유사도 비교입니다. 미리 '질문/대답' 데이터를 만들어 놓습니다. 입력 문장과 데이터의 각 질문을 묶어서 BERT에 집어넣고 동일한지 판단합니다. 그리고 가장 비슷한 데이터의 대답을 출력합니다.

셋째, 답변 매칭입니다. 유사도 비교와 달리 '대답' 데이터만 필요합니다. 사용자의 질문과 각 대답을 같이 BERT에 입력하고 두 문장이 이어지는지 구분합니다. 마찬가지로 가장 자연스러운 대답을 출력합니다. 이렇게 하면 대답 데이터만으로도 좀 더 넓은 범위의 질문들을 커버할 수 있습니다.

핑퐁빌더(https://pingpong.us/)에서 직접 위의 방법들을 테스트해보실 수 있습니다. 일상대화에 있어서는 국내에서 가장 뛰어난 챗봇 중 하나라 생각합니다.

한 가지 궁금한 점이 있는데요. 리액션 모델은 딱 한 번만 수행하기 때문에 크게 부담이 없습니다. 하지만 유사도 비교와 답변 매칭은 모든 데이터들을 사용자의 질문과 하나씩 돌려봐야 합니다. 경량화를 해도 60ms인데, 데이터 문장이 100개라면 6초가 걸립니다. 동접 사용자가 늘어날수록 추론을 위한 리소스가 급격히 증가합니다. 먼저 빠른 알고리즘으로 후보 데이터들을 몇 개만 추출한 다음 BERT에 넣는 방식일까요.

아직은 부족한 발표이지만 봐주셔서 감사드리고 더 좋은 연구와 서비스를 공유드리기 위해 노력하고 있으니 기대해주세요! ㅎㅎ