글 수 210

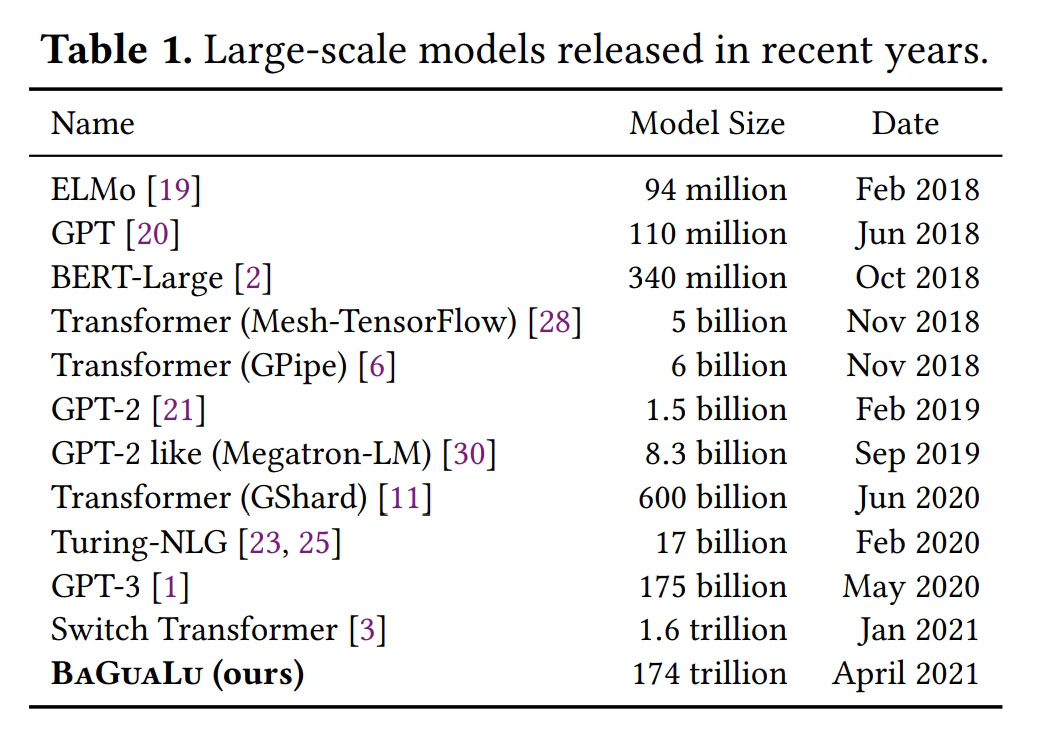

중국 칭화대에서 BaGuaLu(연금술사의 항아리란 뜻의 중국어)라는 슈퍼컴퓨터 기반 딥러닝 모델을 개발했습니다. 174조의 파라미터 사이즈를 가지고 있습니다. 1750억개인 GPT-3의 1000배, 1.6조개인 Switch Transformer의 100배가 넘는 크기입니다.

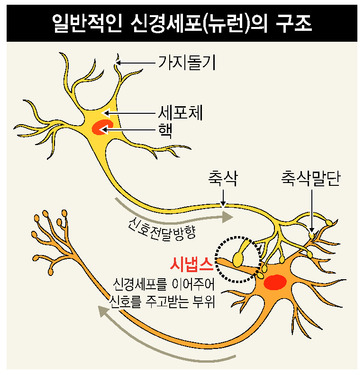

인간의 뇌는 뉴런으로 이루어져 있습니다. 뉴런은 여러 가지돌기에서 입력을 받아 그 합이 일정 수치가 넘으면 축삭돌기로 전달합니다. 이는 전기신호입니다. 다른 뉴런의 가지돌기로 다시 신호를 보내야 하는데 이를 시냅스가 담당합니다. 세르토닌, 도파민, 아세틸콜린 같은 신경전달물질을 통해 화학적 방법으로 정보를 전달합니다. 이때 시냅스가 신호를 증폭하거나 감소시키는데 바로 이곳이 학습이 일어나는 곳입니다.

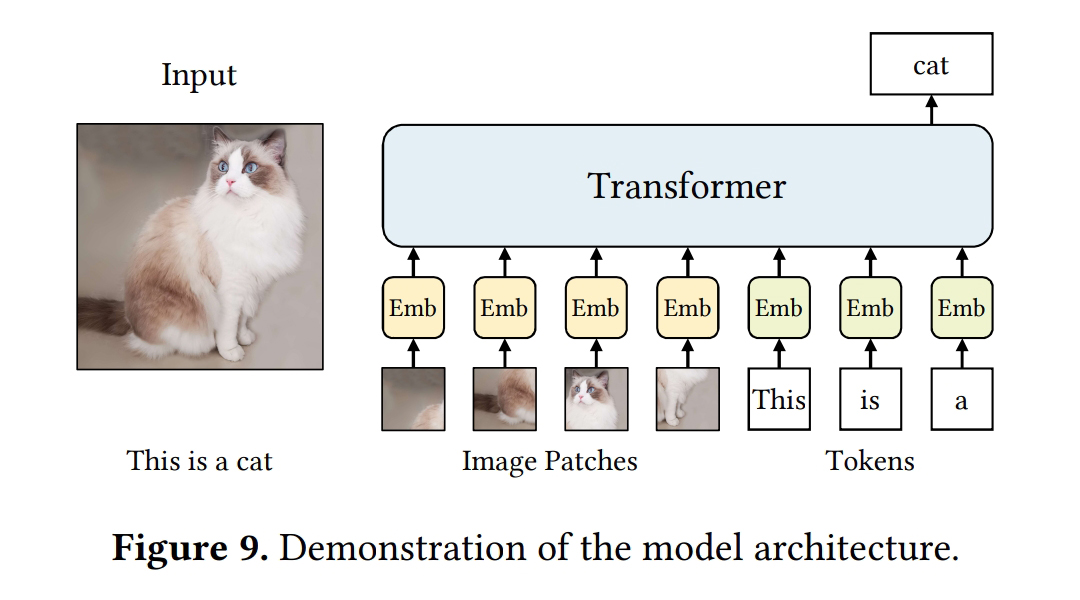

딥러닝 모델의 파라미터가 바로 뉴런의 시냅스와 같은 역할을 합니다. 인간의 뉴런은 1000억개 정도이며, 시냅스는 100조개 이상입니다. BaGuaLu는 최초로 인간 수준의 크기를 가진 인공지능입니다. 논문을 보니 Transformer 구조를 사용한 것 같습니다. 그런데 다른 모델과의 벤치마크 비교가 없어서 정확하게 그 성능을 알 수가 없습니다. 과연 어떤 수준의 인공지능인지 궁금합니다.

< 논문 >

https://keg.cs.tsinghua.edu.cn/.../PPOPP22-Ma%20et%20al...

< 기사 >

https://sports.yahoo.com/china-achieves-brain-scale-ai...