- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

드디어 GPT-4가 공개됐습니다. 아침에 페북을 확인해보니 벌써 다양한 분석글이 올라왔네요. 저도 간단히 요점만 정리해봤습니다.

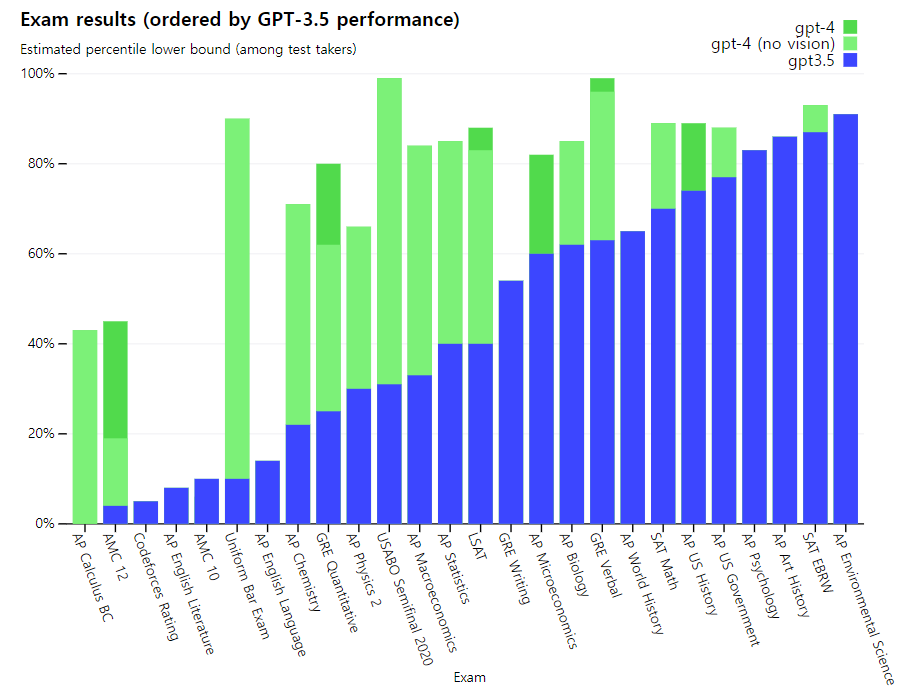

1. 이전 GPT-3.5보다 성능이 더 좋아졌습니다. 실제 시험문제를 가지고 테스트를 해봤습니다. 변호사 시험에서 GPT-3.5는 하위 10%였지만, GPT-4는 상위 10%에 들었습니다. 머신러닝 벤치마크에서도 SOTA를 갱신했습니다.

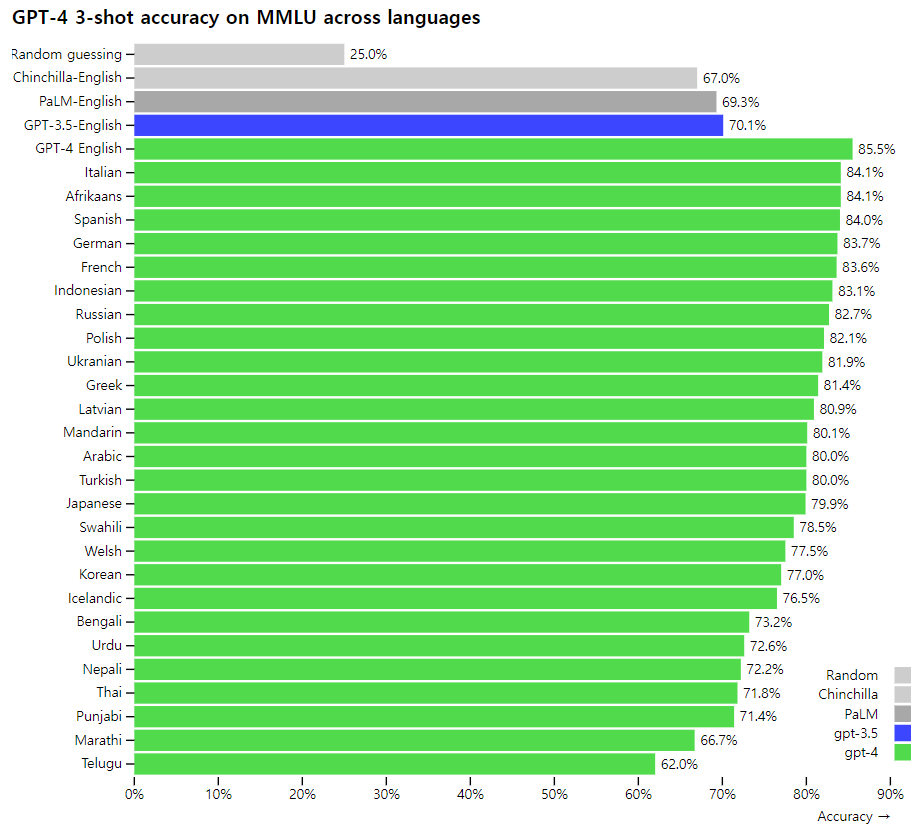

2. 영어가 아닌 다른 언어 능력이 향상되었습니다. 영어로 된 MMLU 벤치마크를 다양한 언어로 번역하고 이를 GPT-4로 풀어봤습니다. 그랬더니 GPT-3.5 영어보다 높은 점수를 얻었습니다. 한국어 역시 정확도 77%로 GPT-3.5 영어의 70.1%보다 높았습니다.

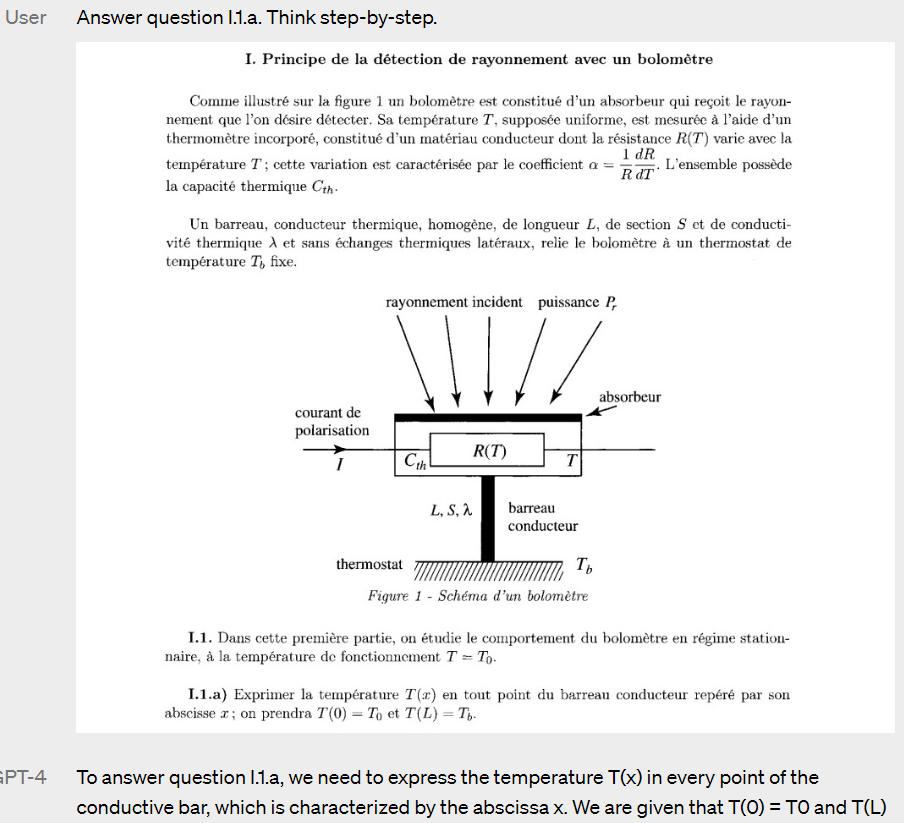

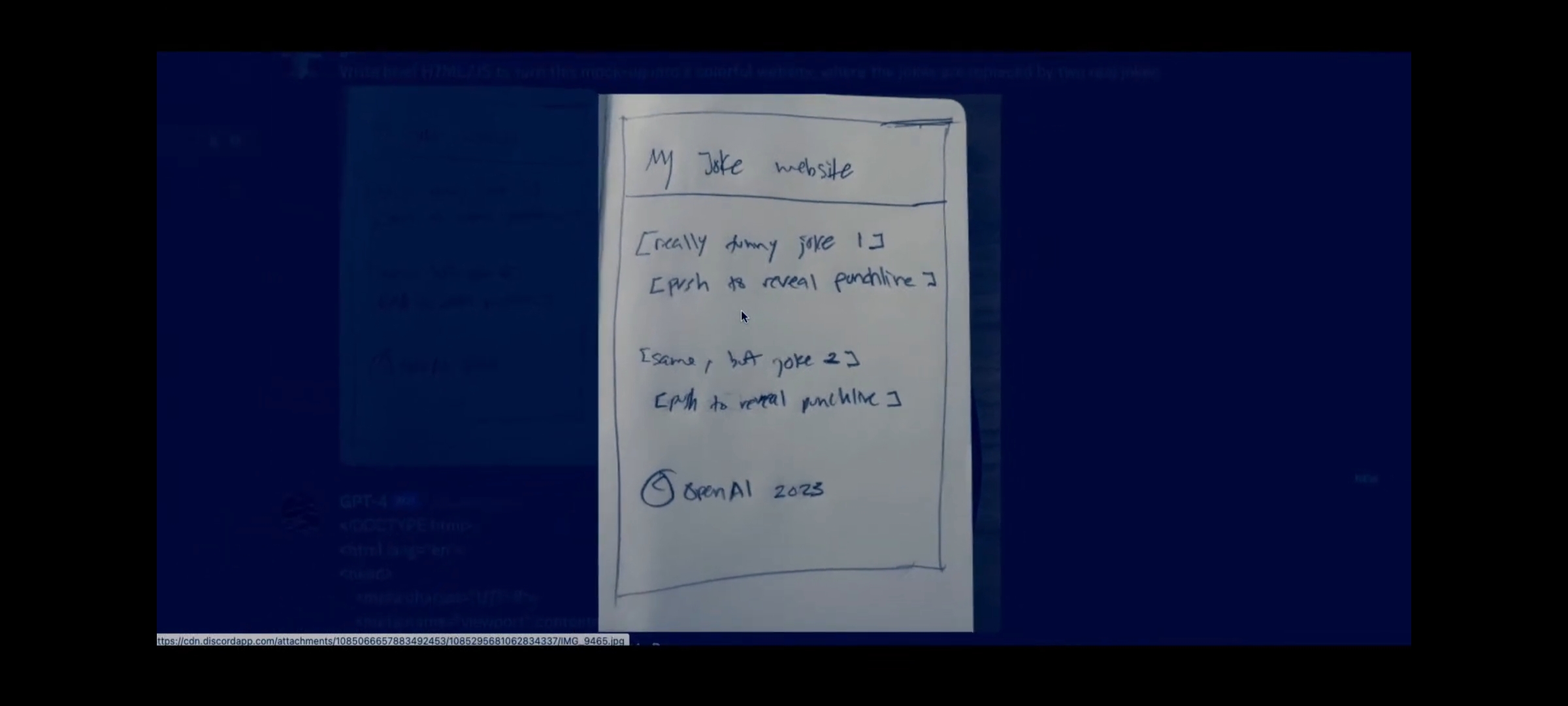

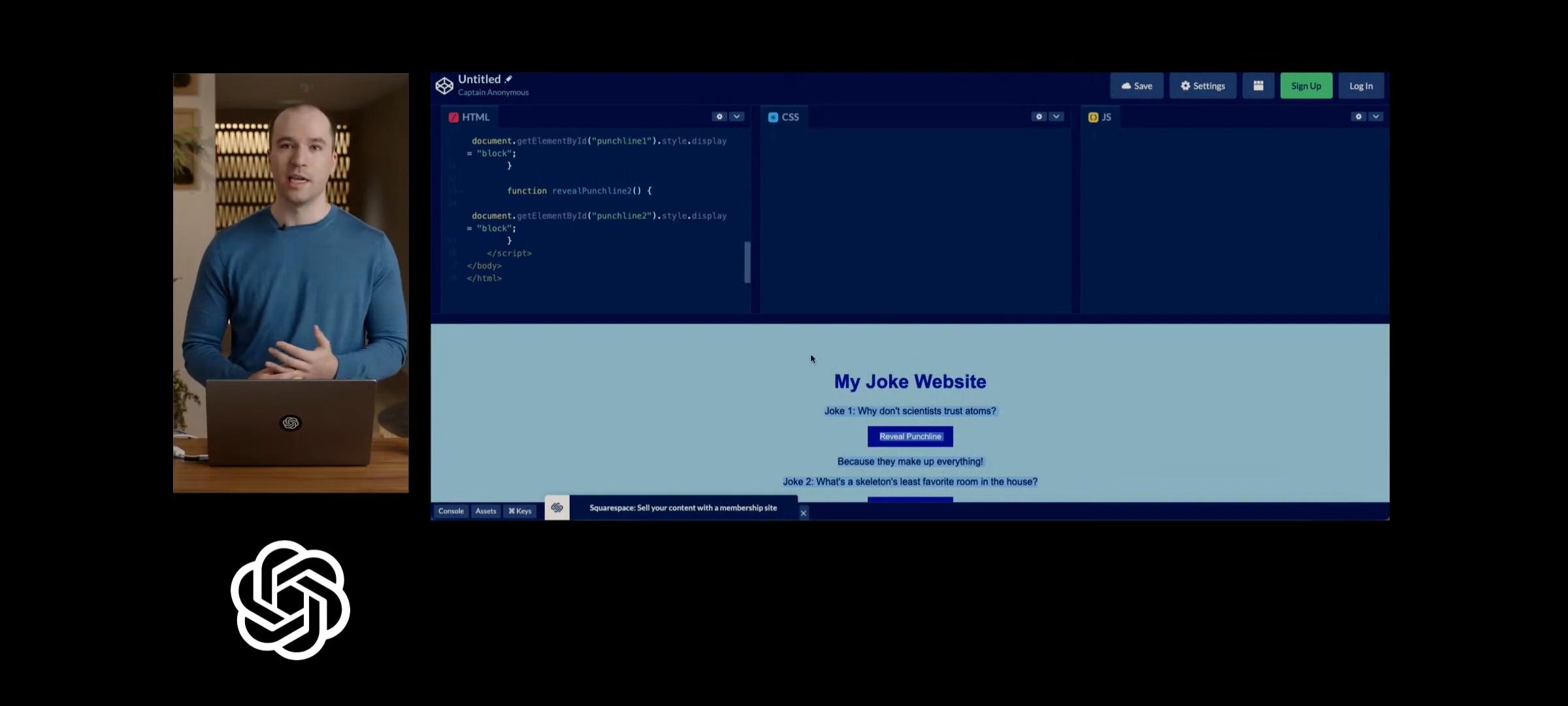

3. 예상했었던 것처럼 멀티모달 모델입니다. 사진도 입력으로 받을 수 있습니다. 사진을 넣고 여기에 대해서 설명하라고 하면 정확히 대답합니다. 신기한 점은 시험문제 사진을 보고 문제를 풀 수 있다는 것입니다. OCR로 텍스트를 변환하는게 아니라 사진 속 글자 자체를 이해하는 것 같습니다. 시험문제를 보면 텍스트의 위치도 중요한 정보니까요. 사진으로 코드를 작성할 수도 있습니다. 스케치로 화면 UI를 그리면 HTML과 자바스크립트로 변환해줍니다.

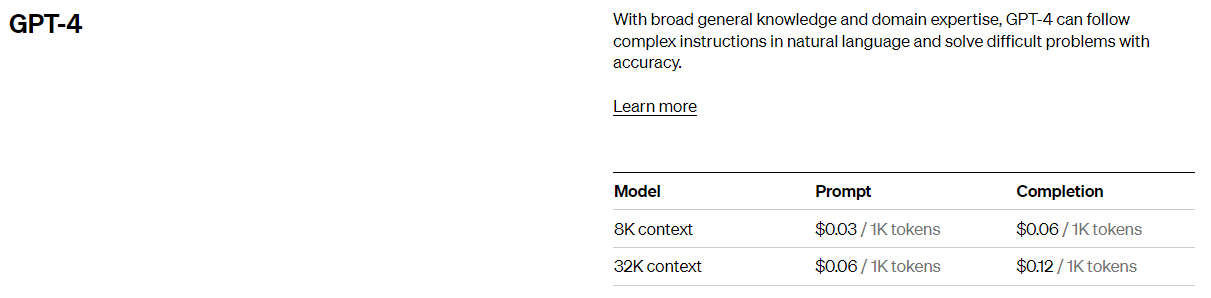

4. 최대 토큰의 길이가 훨씬 커졌습니다. GPT-3.5는 4K였지만 GPT-4는 8K과 32K 두 개의 버전이 있습니다. 영어책 한권의 단어수가 보통 9만개입니다. 토큰수은 단어수의 3/4 정도니 7만개입니다. 32K면 책 반권 정도의 분량입니다.

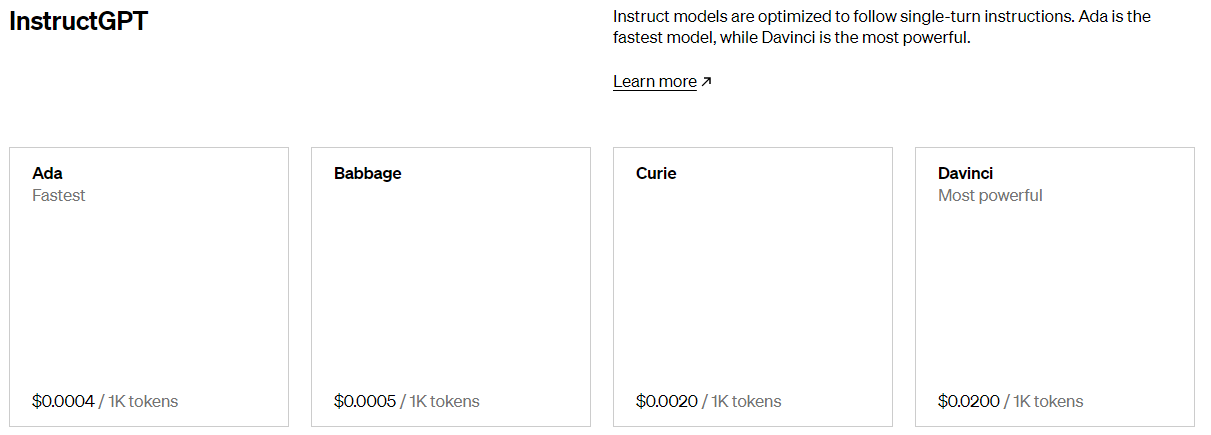

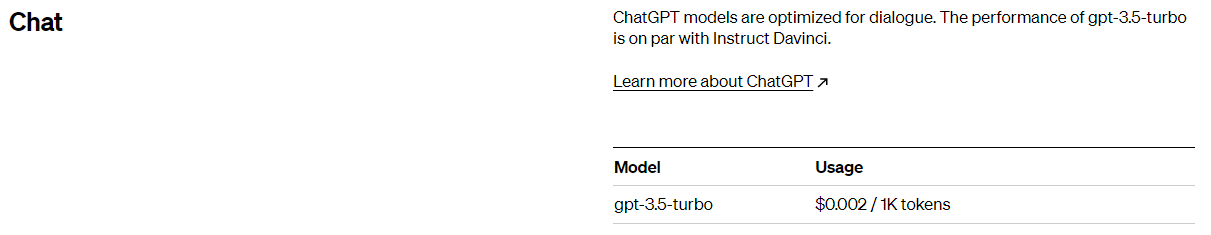

5. 가격은 조금 비싸졌습니다. GPT-3.5는 1K 토큰당 $0.02입니다. GPT-4는 프롬프트와 출력의 가격이 다릅니다. 8K 버전은 프롬프트 $0.03, 출력 $0.06이고, 32K 버전은 프롬프트 $0.06, 출력 $0.12입니다. 8K만 비교하면 GPT-4가 GPT-3.5보다 2배 정도 비싸졌습니다. 참고로 ChatGPT는 $0.002로 매우 싼 편입니다.

6. 경쟁업체와 안전상의 이유로 모델 아키텍처는 공개하지 않았습니다. 모델 사이즈, 하드웨어, 학습 계산량, 데이터셋, 학습 방법 등 모두 비밀입니다. 딥러닝 초기에는 구글이나 OpenAI 같은 글로벌 기업들이 기술을 자유롭게 공개했습니다. 그래야 빠르게 발전할 수 있었기 때문입니다. 이제는 상용화 단계에 접어들며 업체들간의 경쟁이 치열해졌습니다. 앞으로는 이런 폐쇄적인 분위기가 계속될 것 같습니다.

저는 무엇보다 한글 성능이 높아졌다는게 가장 우려됩니다. ChatGPT도 처음에는 우리말을 잘 이해하지 못했는데요. 그래서 영어로 번역하는 크롬 확장프로그램을 사용하기도 했습니다. 이제는 한글로 해도 충분히 쓸만해졌습니다.

앞으로 초거대AI가 다중언어로 발전한다면 한국이 해외 기술에 종속될수도 있습니다. 게다가 이제 기술 공개도 안하고 자기들만의 벽을 더욱 공고히 할 테니까요. 클라우드처럼 초거대AI도 2~3개 업체만 남을 가능성이 큽니다. 요즘 LLM도 오픈소스의 열풍이 거세지만 결국 한계가 있다고 봅니다. 검색에서 구글의 독주를 막은 것처럼 인공지능 역시 국내 기업의 선전을 기대해봅니다.

< GPT-4 블로그 >

https://openai.com/research/gpt-4