- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 283

https://www.facebook.com/seongwan.kim.3/posts/9185808398110883

ChatGPT의 in-context learning에 대해 잘 설명한 글입니다. 사실 이게 LLM의 가장 강력한 특징인데요. 기존 BERT 같은 사전훈련 모델은 새로운 데이터로 파인튜닝을 해야했습니다.

하지만 초거대AI인 GPT-3의 등장으로 학습방법이 완전히 바뀌었습니다. 입력에 prompt를 넣어서 이렇게 하라고 말로 설명만 하면 됩니다. 이때 몇 가지 예시를 넣어주면 더욱 좋습니다. 이런 방법을 few-show learning이라고 합니다. in-context learning과 few-shot learning은 비슷한 개념이라고 보시면 됩니다.

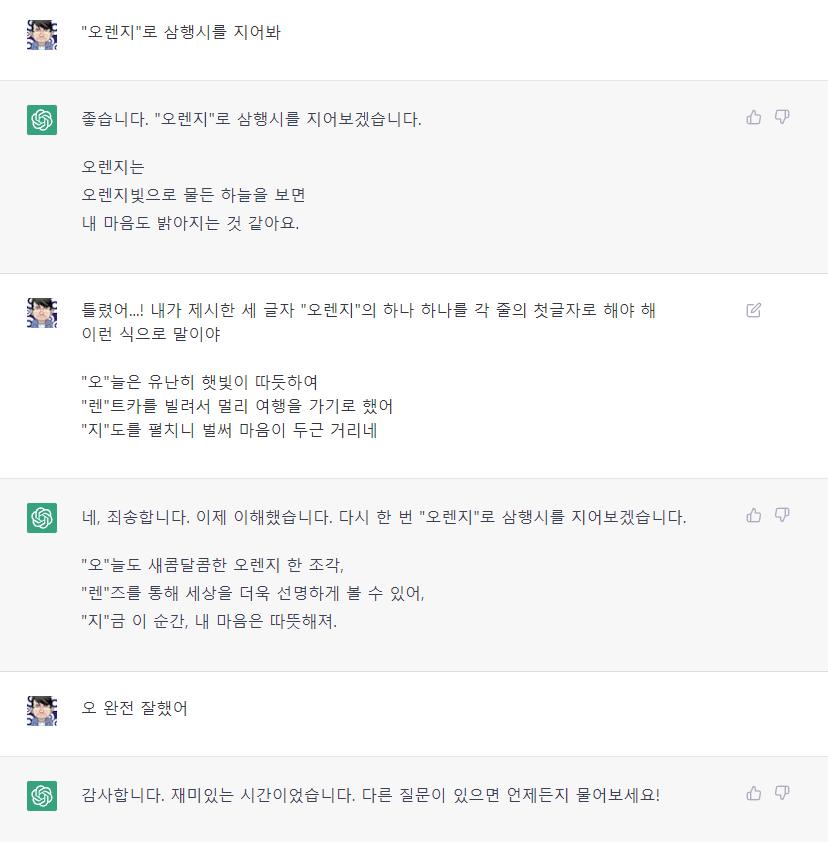

그런데 ChatGPT가 나오면서 in-context learning이 더욱 강화되었습니다. 이전 GPT-3는 prompt 안에서 few-shot이나 one-shot으로만 예시를 추가했는데요. ChatGPT는 대화를 계속 주고받으면서 가르칠 수 있게 되었습니다. 이게 UX 측면에서 엄청난 차이라고 생각합니다. 그래서 ChatGPT가 이처럼 큰 인기를 끌게 된 것일 수도 있고요.