- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 283

https://www.facebook.com/groups/TensorFlowKR/permalink/1210069189334137/

요즘 자고 일어나면 새로운 딥러닝 기술이 계속 나오고 있는데요. 얼마 전 OpenAI가 GPT3라는 혁신적인 모델을 공개했습니다. 우선 파라미터가 GPT2의 1.5B에서 100배(!) 증가한 175B입니다. 기존 최고였던 T5의 11B보다도 10배나 높습니다. 이 정도 모델을 학습할 수 있는 회사는 전세계에서 손에 꼽을 듯 합니다. 정확히는 모르겠지만 아마 한 번 사전훈련시키는데 최소 몇억에서 수십억이 들거라 봅니다.

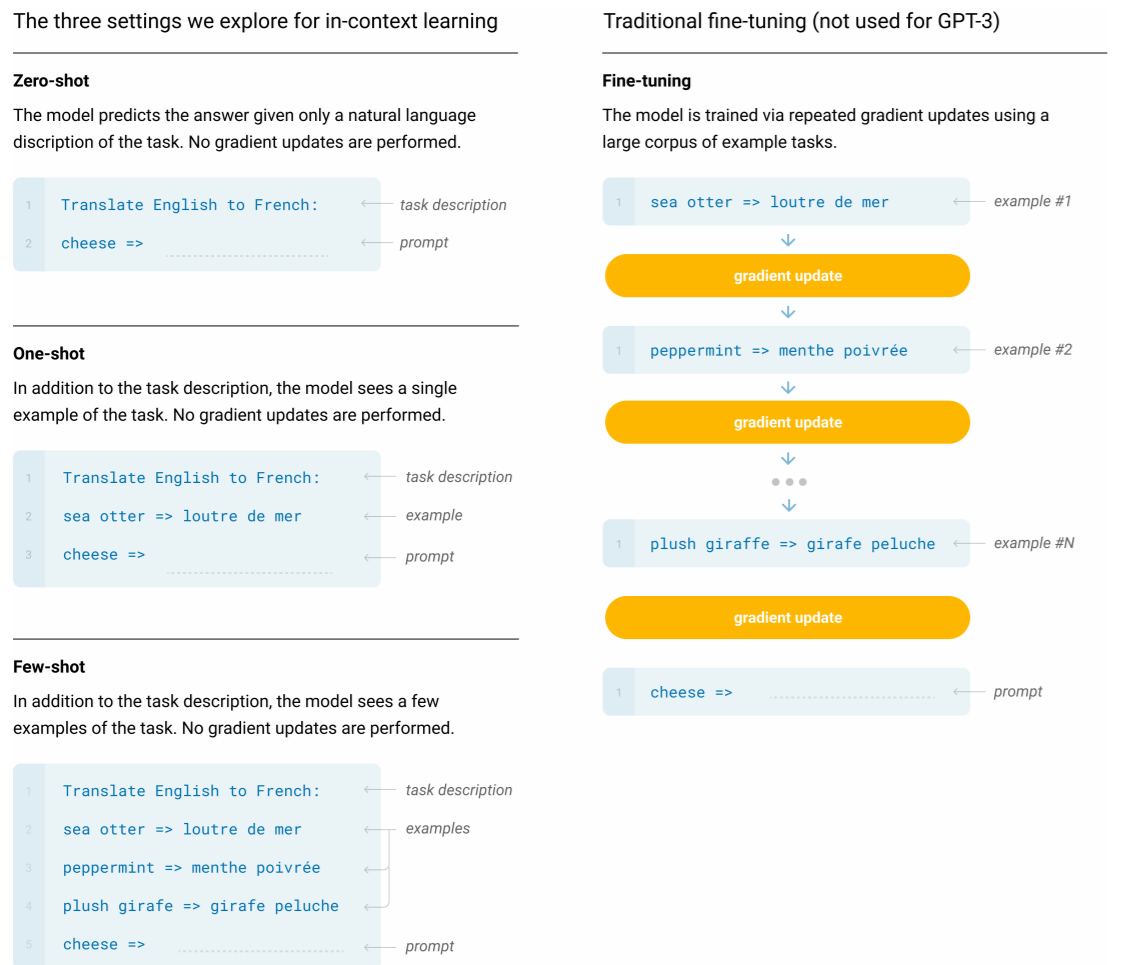

GPT2와 또 다른 차이점은 퓨삿러닝(few-shot)에 최적화 되어있다는 것입니다. 과거의 딥러닝은 사전훈련된 모델을 비교적 적은 데이터로 다시 학습시키는 파인튜닝을 사용했습니다. 제로샷, 원샷, 퓨샷러닝은 보통 따로 그래디언트 학습을 하지 않습니다. 제로샷은 사전훈련된 모델을 바로, 원샷은 하나의 예제만, 퓨샷은 몇 개의 예제만으로 새로운 도메인의 문제에 적용할 수 있습니다. 이렇게 해도 GPT3가 기존 파인튜닝한 모델들과 동급, 또는 더 높은 성능을 보였다고 합니다.

좀 더 자세한 내용은 링크의 글을 참조하시기 바랍니다.