- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 285

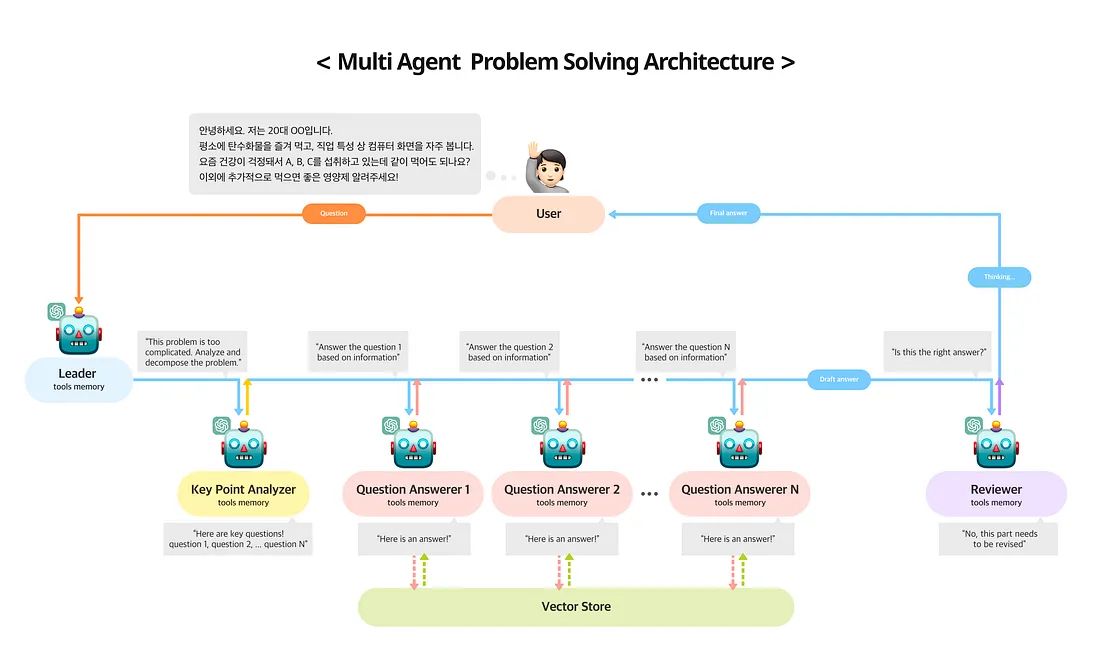

최근 제가 가장 관심있게 보는 기술이 멀티에이전트 협업(multi-agent collaboration)입니다. Generative Agents와 ChatDev가 가장 대표적입니다. ChatGPT 같이 LLM이 한 번에 대답하지 않고, 여러 에이전트로 구분하여 협업을 합니다. 각 에이전트들은 각자 자신의 역할을 가지고, 이 역할에 따라 다른 작업을 수행합니다. 이렇게 AI끼리 서로 대화를 하며 최종 결과물을 만들어냅니다.

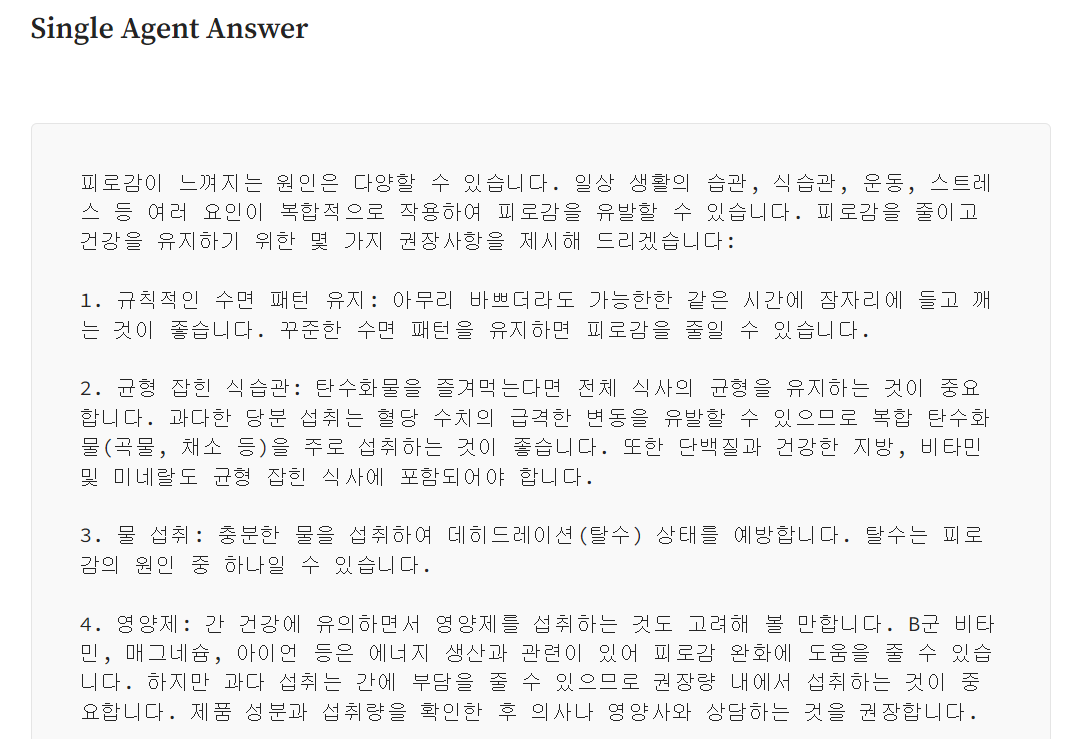

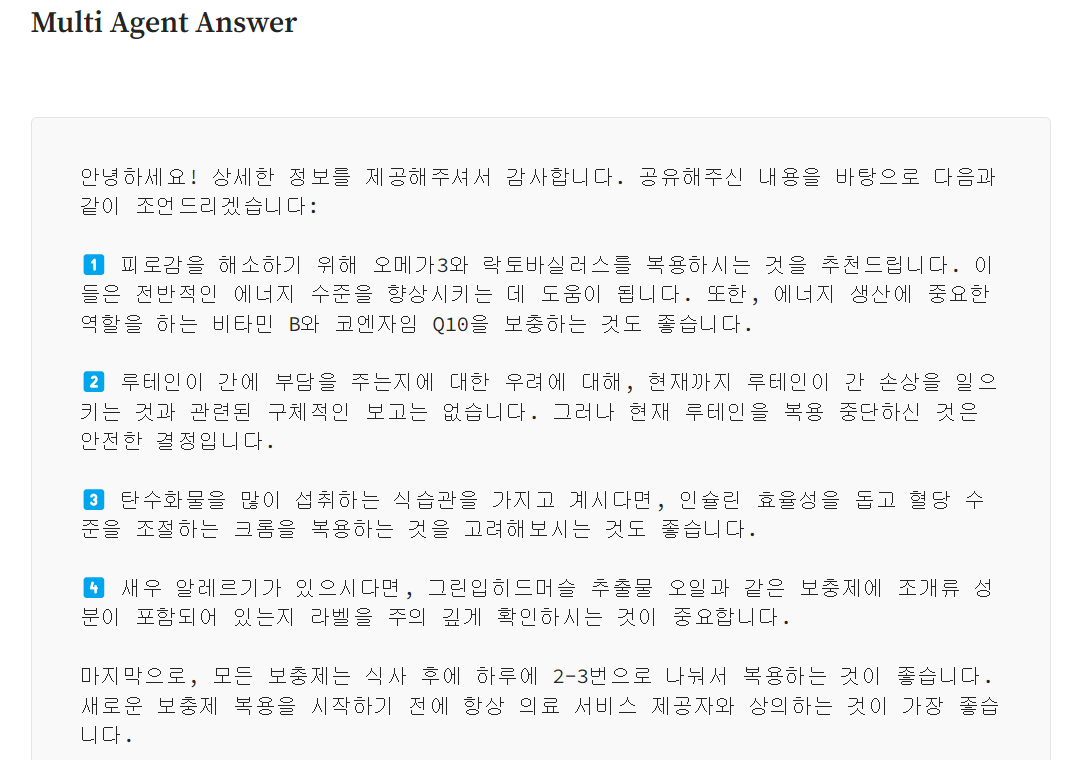

헬스케어 QA 챗봇에 멀티에이전트를 도입한 글입니다. 싱글 LLM만 썼을 때는 대답이 평이하고 나열식으로 정보를 제공합니다. 반면에 여러 에이전트로 역할을 지정하고 각각 생성한 내용을 취합하니 대답 품질이 훨씬 높아졌습니다.

대단하군요.

마치 적대적 신경망이

서로 경제하면 성능을 끌어올리는것과 비슷한건가요?