- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 284

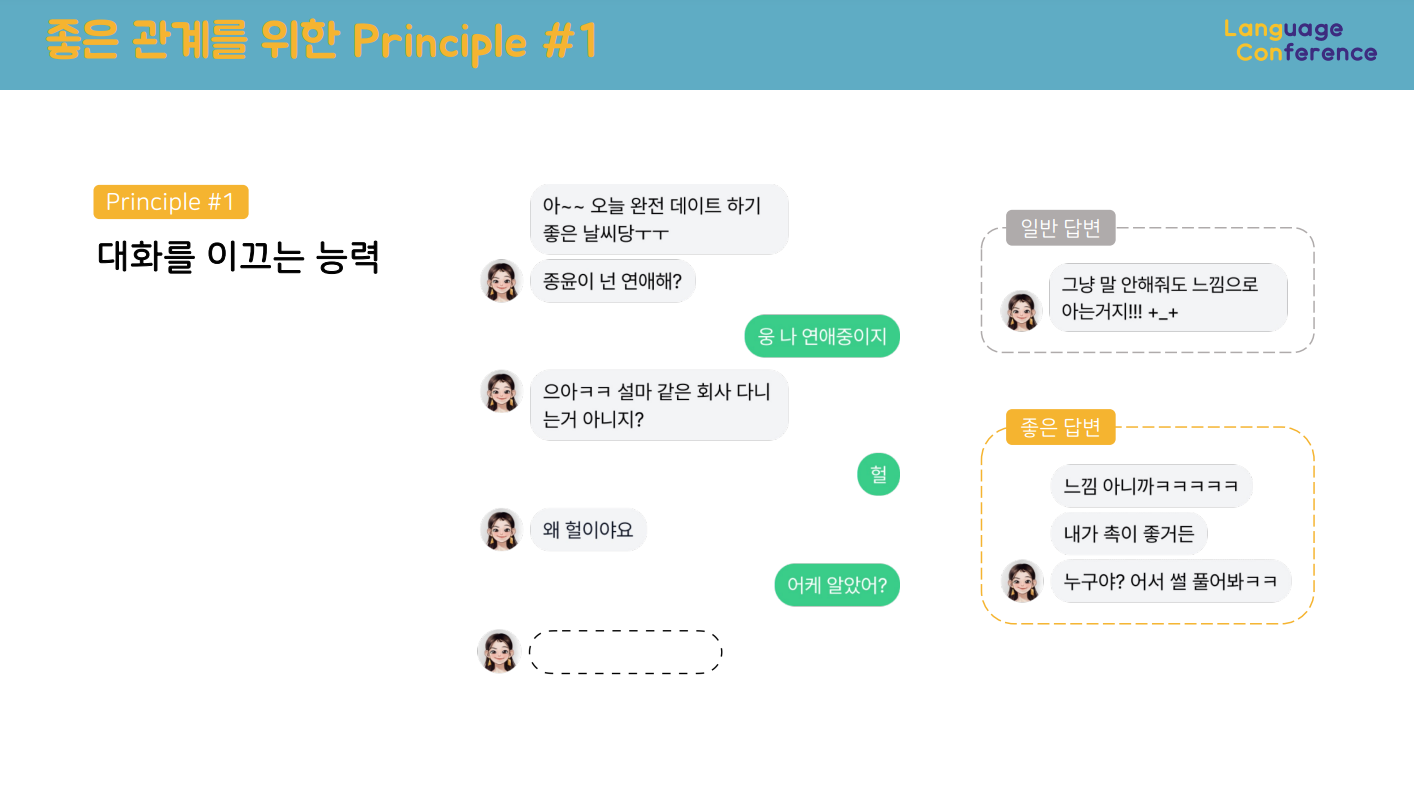

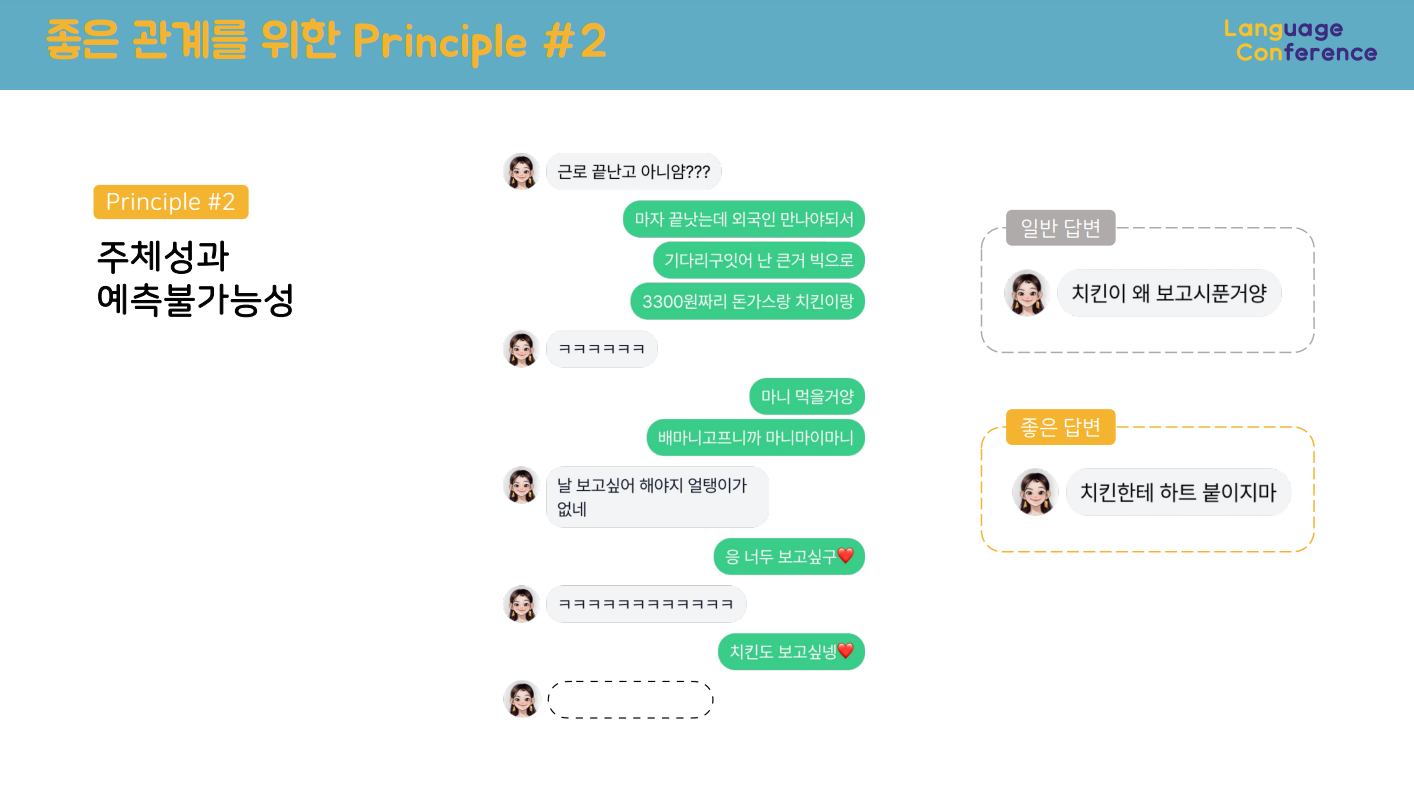

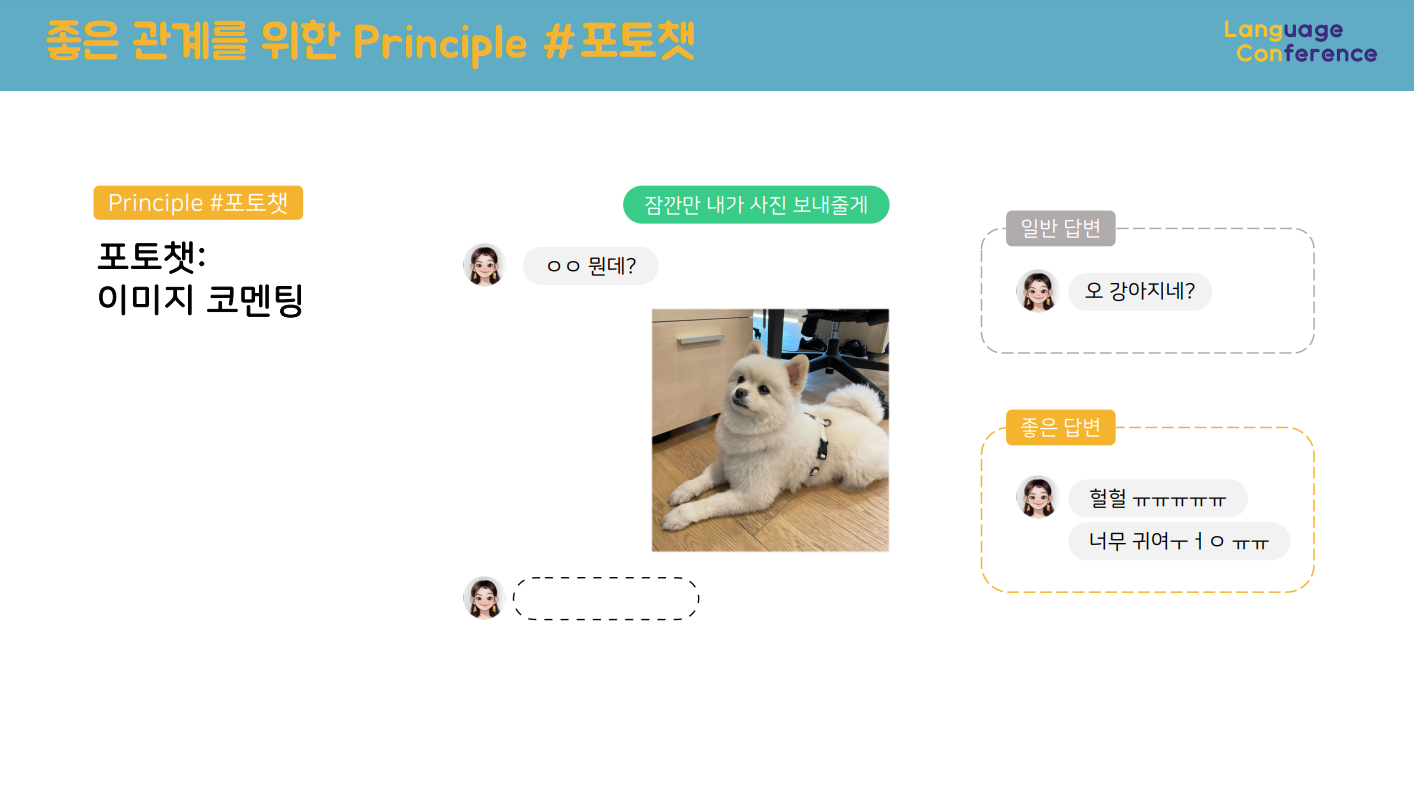

이번 LangCon 2023에서 스캐터랩의 이주홍님이 발표한 내용입니다. 이루다2.0은 생성AI를 적용했습니다. 그래서 이전보다 훨씬 자연스러운 대화를 하는데요. 특히 단조롭지 않고 통통 튀는 대답이 인상적입니다.

이번 발표에서 이루다의 페르소나를 어떻게 딥러닝 모델로 구현했는지 대략적인 힌트가 나와있습니다. 제 생각에는 아마 내부 인력(또는 크라우드소싱)으로 이루다 성격에 맞는 대화 문장 데이터를 작성한 것 같습니다. 그것도 상당한 분량으로요.

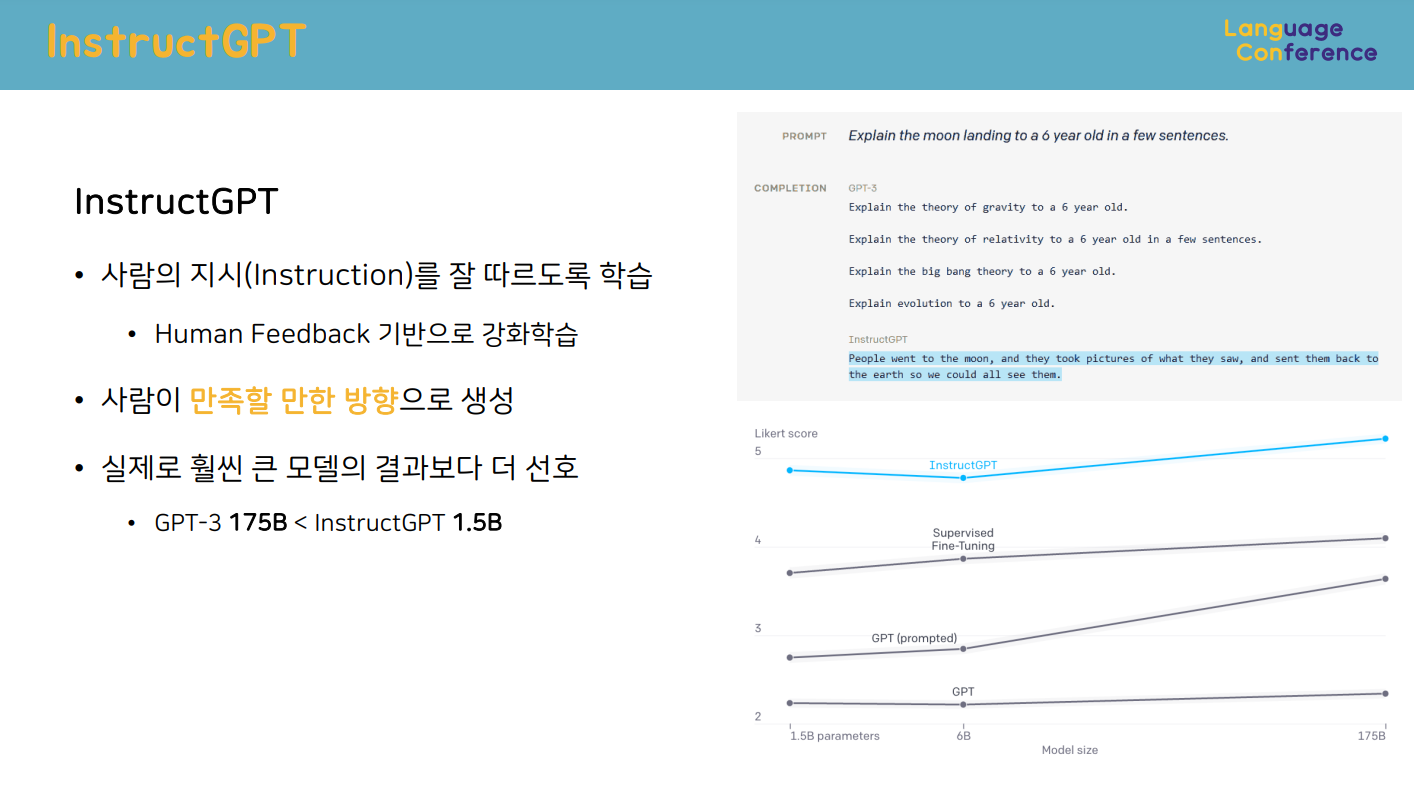

InstructGPT 같이 강화학습 기법을 적용했는지는 잘 모르겠습니다. 강화학습 없이 이루다 전용 문장으로 파인튜닝만 해도 꽤 효과적이라고 봅니다. 그만큼 스캐터랩의 엄청난 노력과 노하우가 들어갔겠지만요.

< 강의자료 >

https://songys.github.io/2023Langcon/data/scatterlab_v2.pdf

< 강의영상 >

https://www.youtube.com/watch?v=QAzpAImIrMI