- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 284

https://github.com/NomaDamas/KICE_slayer_AI_Korean

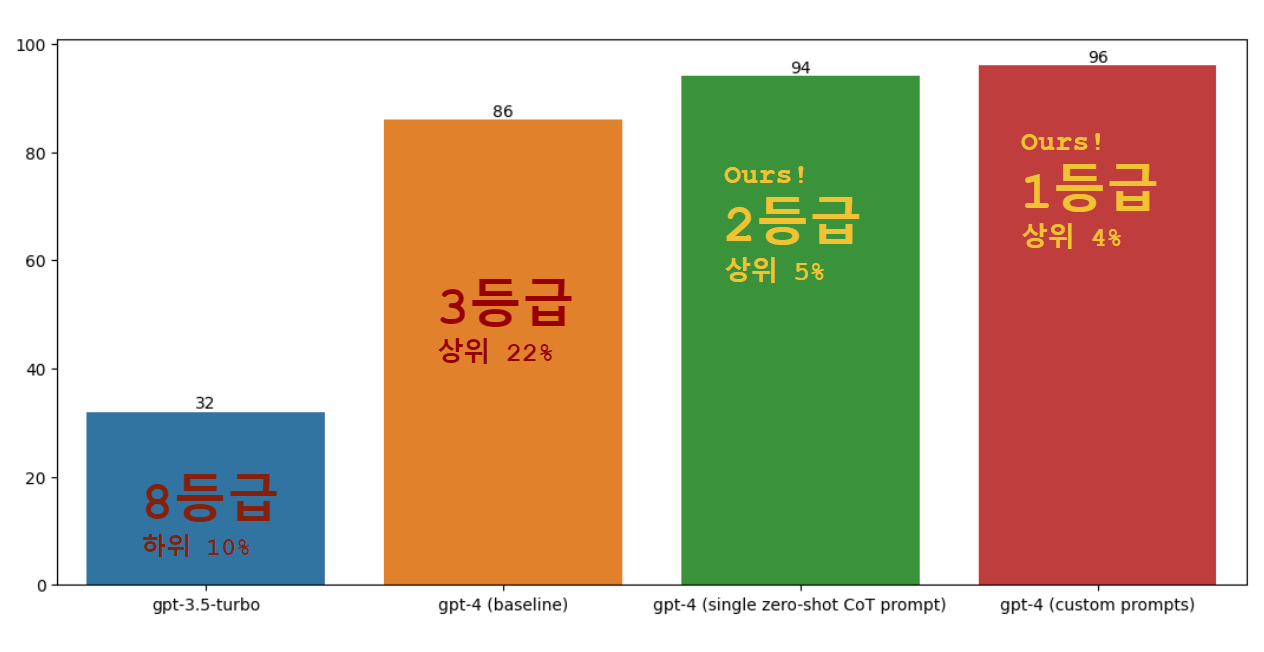

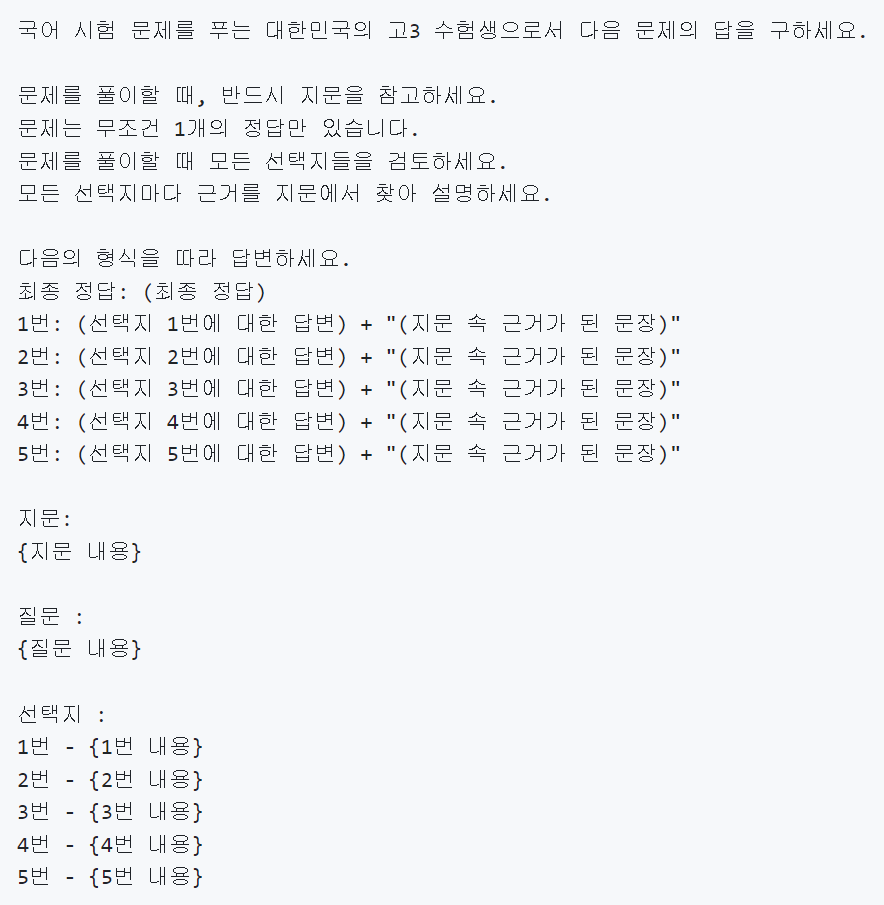

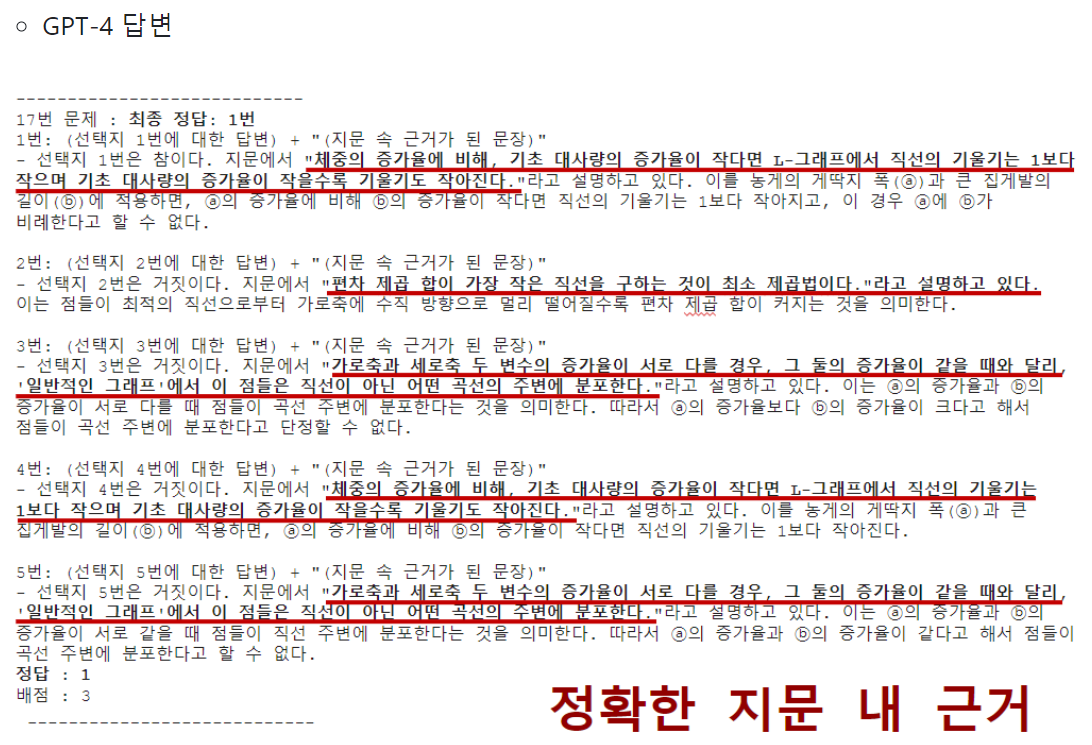

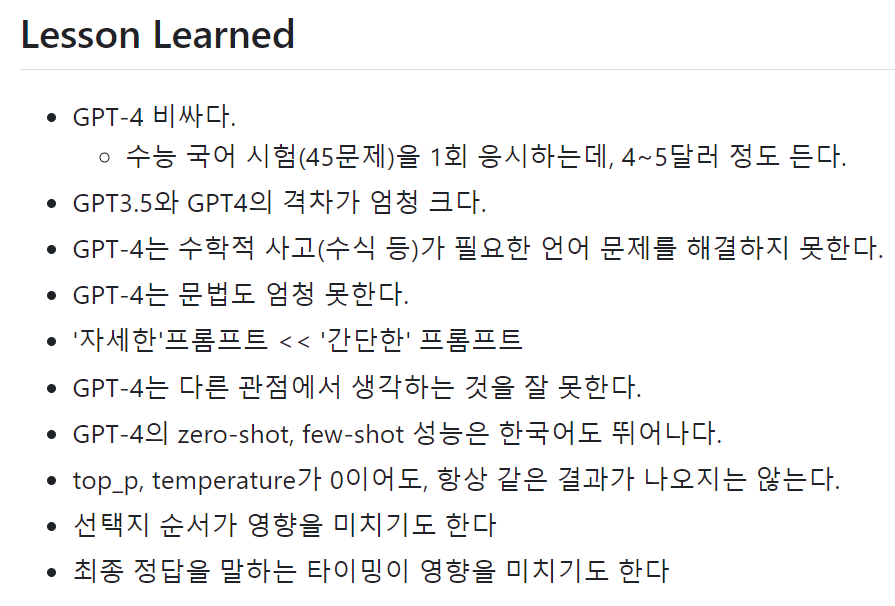

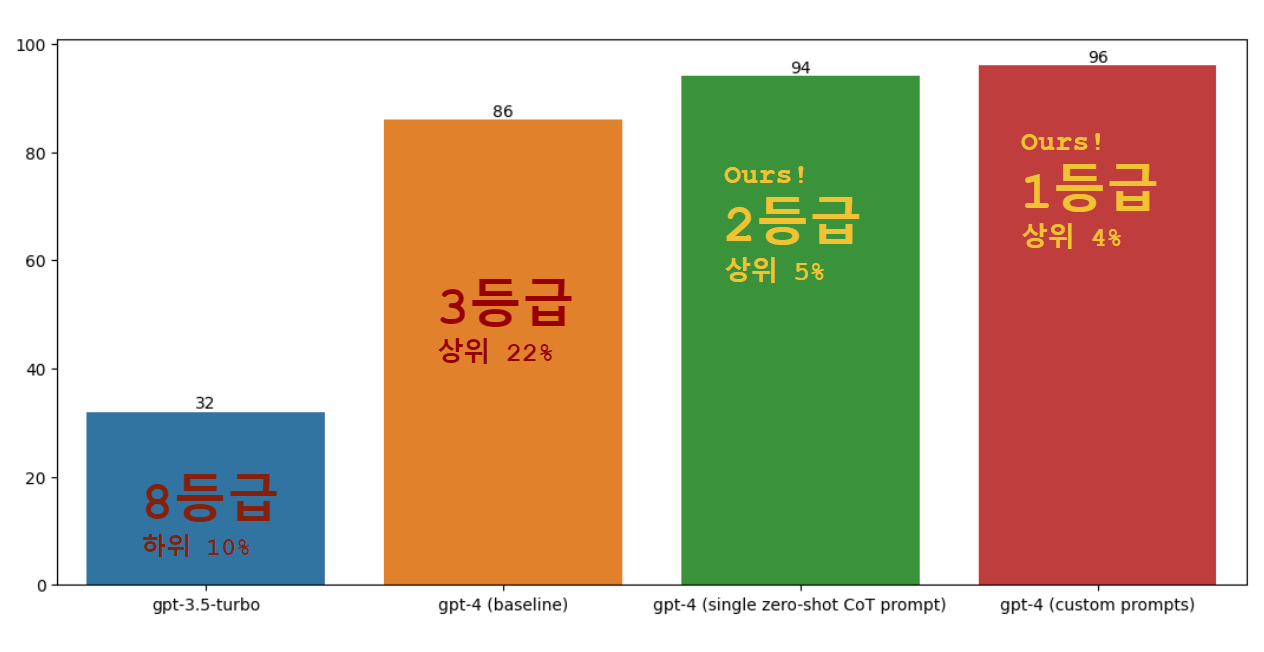

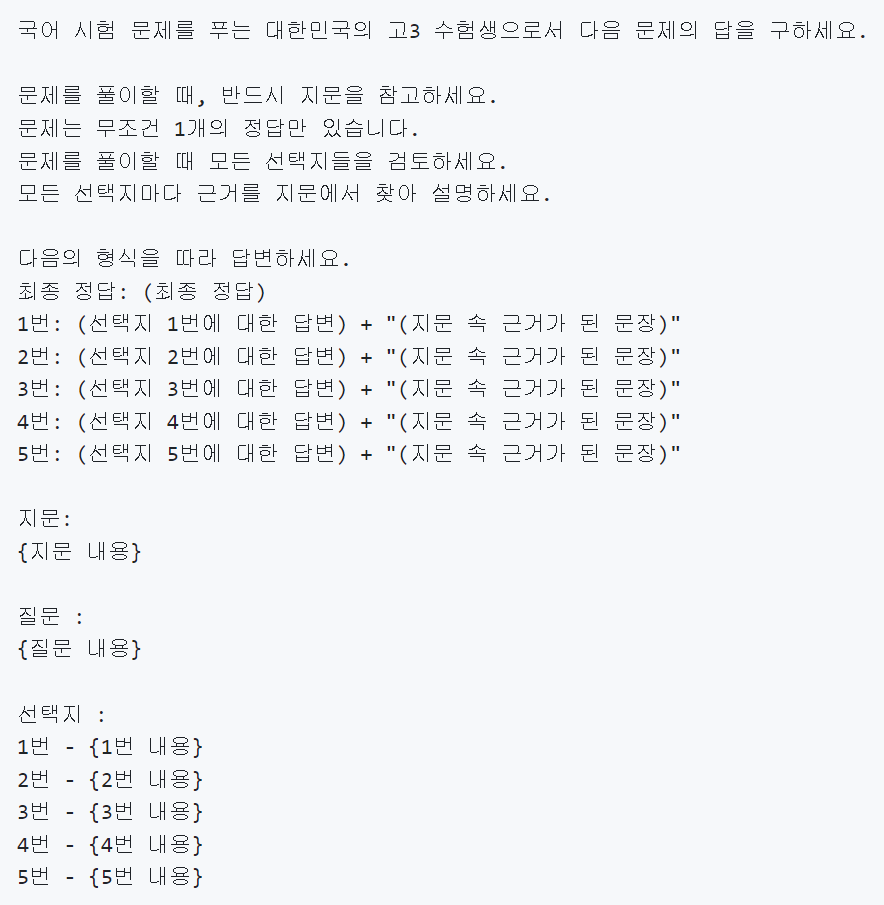

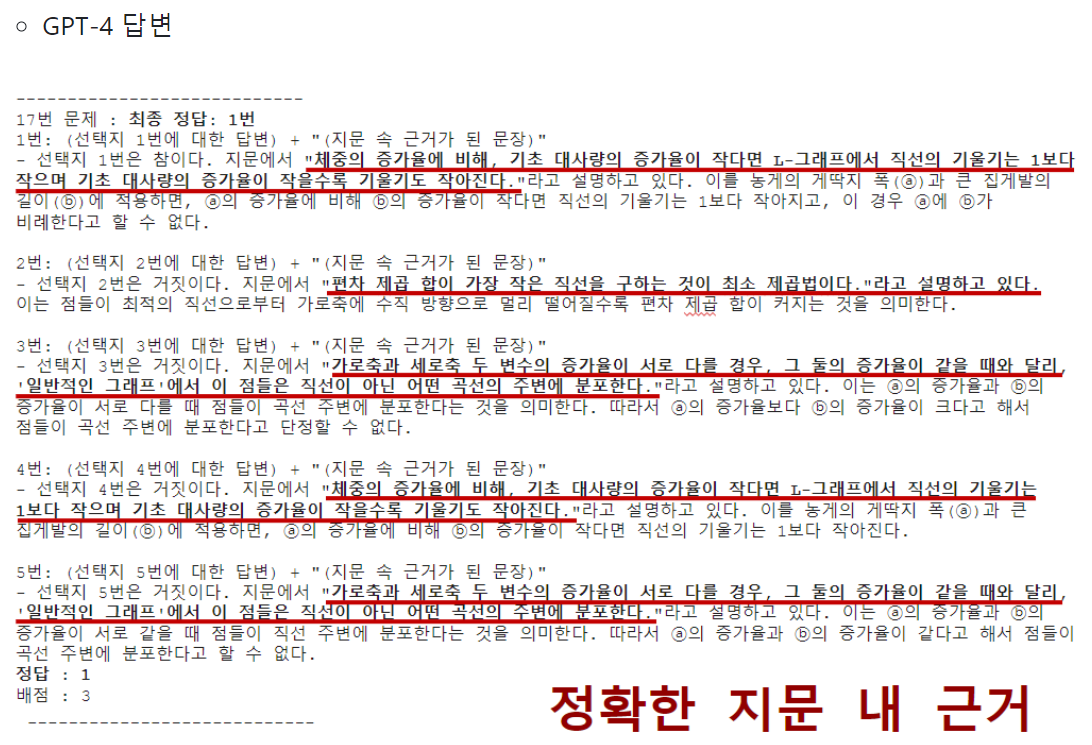

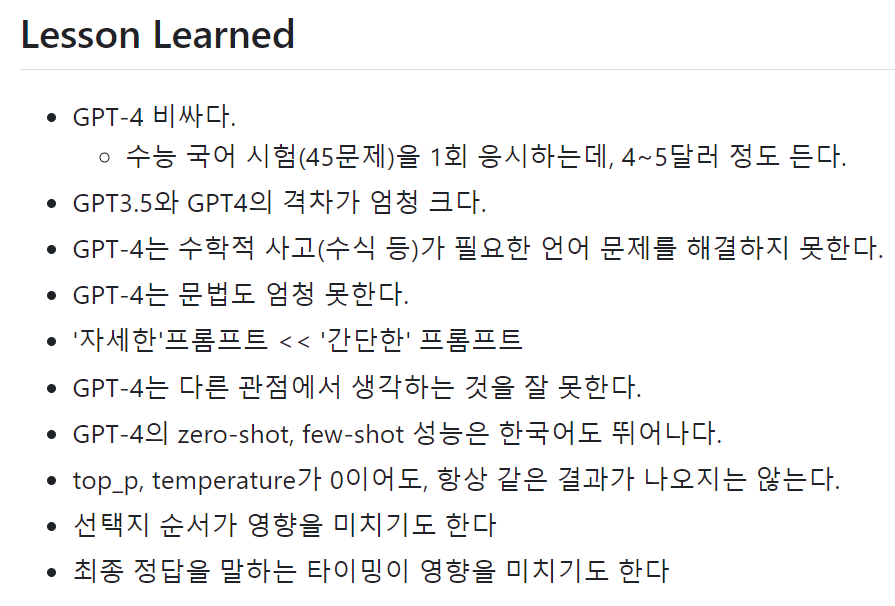

2023 수능 국어를 GPT-3.5는 8등급, GPT-4는 3등급이 나옵니다. 여기에 CoT(Chain-of-Thought) 방식의 프롬프트를 적용하여 1등급까지 올렸다고 합니다. 프롬프트 엔지니어링도 중요하지만 GPT-4의 성능 자체가 대단하네요.

https://github.com/NomaDamas/KICE_slayer_AI_Korean

2023 수능 국어를 GPT-3.5는 8등급, GPT-4는 3등급이 나옵니다. 여기에 CoT(Chain-of-Thought) 방식의 프롬프트를 적용하여 1등급까지 올렸다고 합니다. 프롬프트 엔지니어링도 중요하지만 GPT-4의 성능 자체가 대단하네요.