- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 283

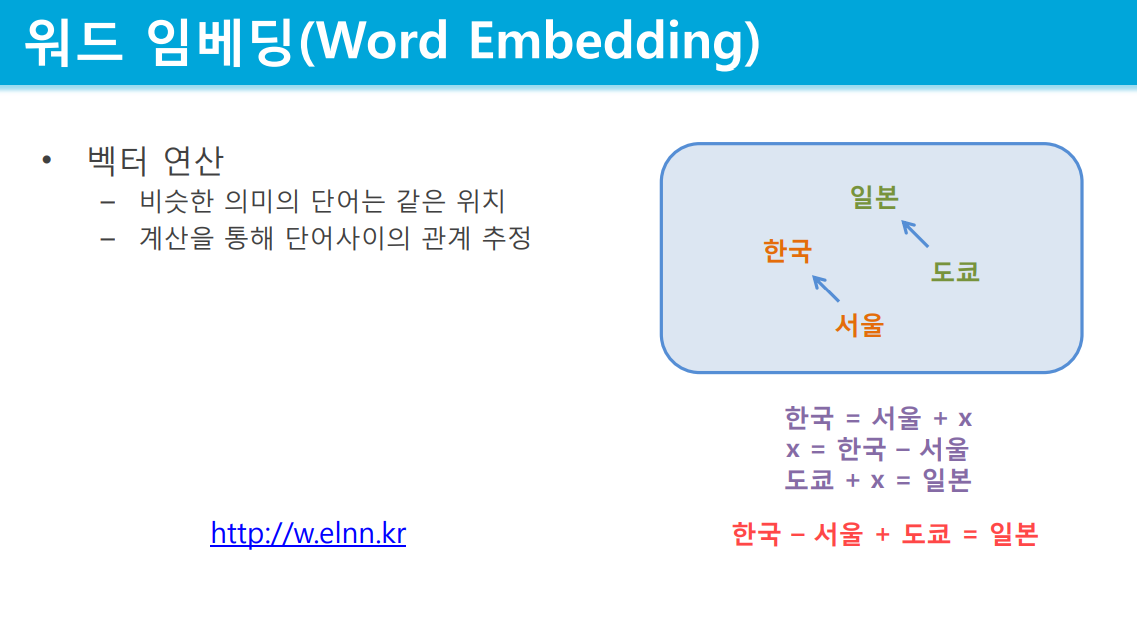

딥러닝 자연어처리의 기본인 워드 임베딩(word embedding)을 한글로 테스트하는 사이트입니다. 첨부한 그림처럼 x라는 벡터의 차이만큼 새로운 단어를 찾을 수 있습니다. 주의할 점은 '한국-서울+도쿄 = 일본' 처럼 'A-B+C'에서 C는 B와 같은 종류(여기서는 수도)를 가져야 한다는 것입니다.

몇가지 예를 들어보면 다음과 같습니다. 하지만 모든 경우에 대해서 완벽하게 동작하지는 않습니다^^;

여자-여왕+왕 = 남자

개그맨-유재석+아이유 = 가수

유재석-개그맨+가수 = 김경호(?)

일본-우동+불고기 = 한국

우동-일본+한국 = 짜장