- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 284

https://blog.pingpong.us/gpt3-limit/

"GPT-3가 생각을 하는 걸까요 아니면 통계적 예측을 하는 걸까요? 둘 중 하나에 속한다는 걸 어떻게 증명할까요? 둘이 정말 큰 차이가 있거나 확실히 구분되는 걸까요? 과연 ‘생각’을 한다는 건 정확히 무슨 의미일까요? 이러한 질문에 확실한 정답을 말해줄 수 있는 사람은 없을 겁니다."

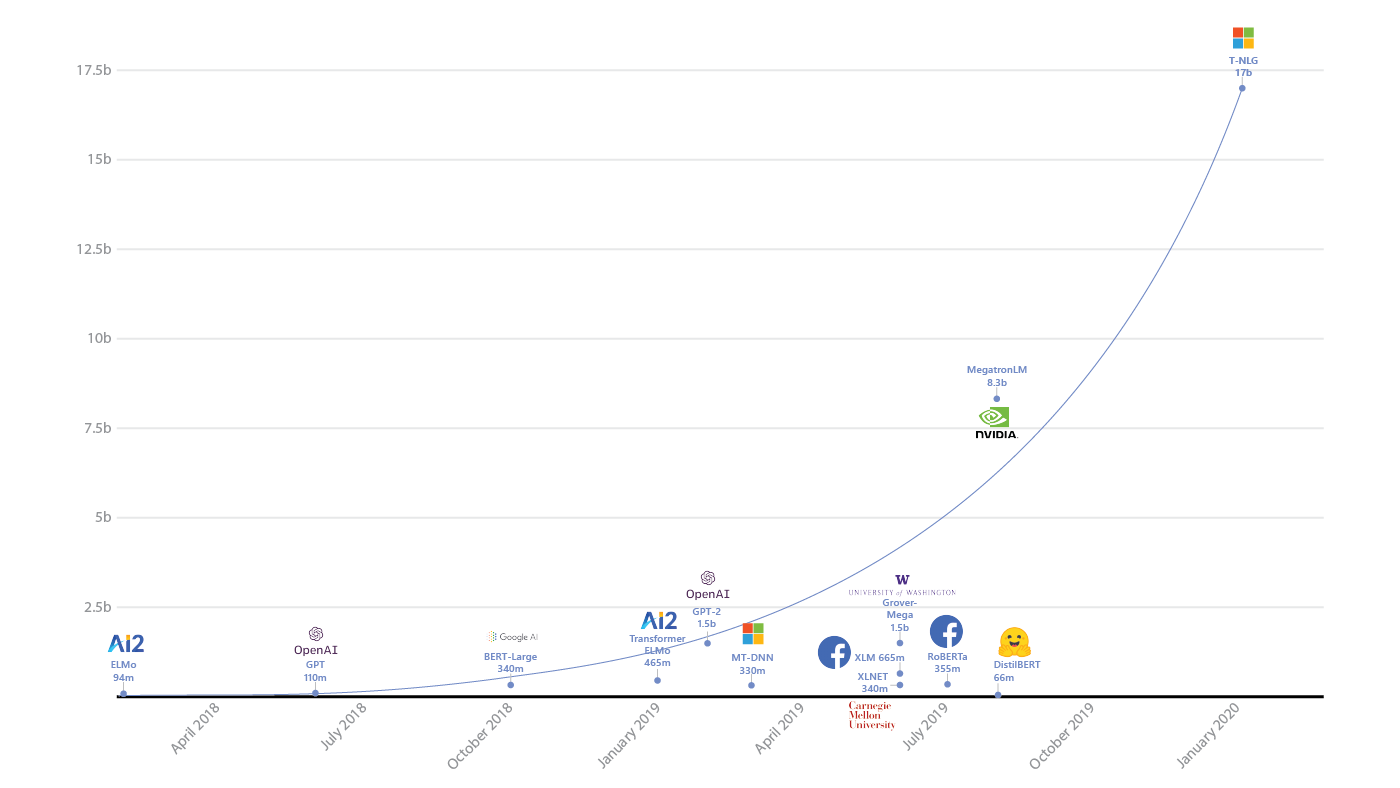

GPT3의 한계에 대해서 잘 정리한 글입니다. 저도 위의 의견에 대해서 상당히 공감합니다. GPT3가 단순히 단어의 빈도수만 가지고 문장을 예측하지는 않는 것 같습니다. 문맥을 파악하고 전체적인 의미를 이해하기 때문에, 그만큼 높은 수준의 글들을 생성할 수 있습니다.

어떤 사람들은 딥러닝을 단순히 통계적 예측이라고 하기도 합니다. 개인적으로는 신경망과 통계는 큰 차이가 있다고 봅니다. 보통 통계라고 하면 수식으로 명확하게 설명이 가능합니다. 반면에 신경망은 왜 그런 결과가 나오는지 이론적으로 증명이 어렵습니다. 물론 우리가 알지 못할 뿐, 신경망에도 내부적으로 어떤 공식이 있을지도 모릅니다. 하지만 복잡계(complex system)처럼 아직 인간의 능력으로는 벅찬 문제입니다.

언젠가는 그 비밀이 밝혀지게 될까요. 하지만 그렇지 않더라도 딥러닝이 가진 잠재력은 무한하다고 생각합니다.