- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 283

https://tech.kakaoenterprise.com/43?category=882488

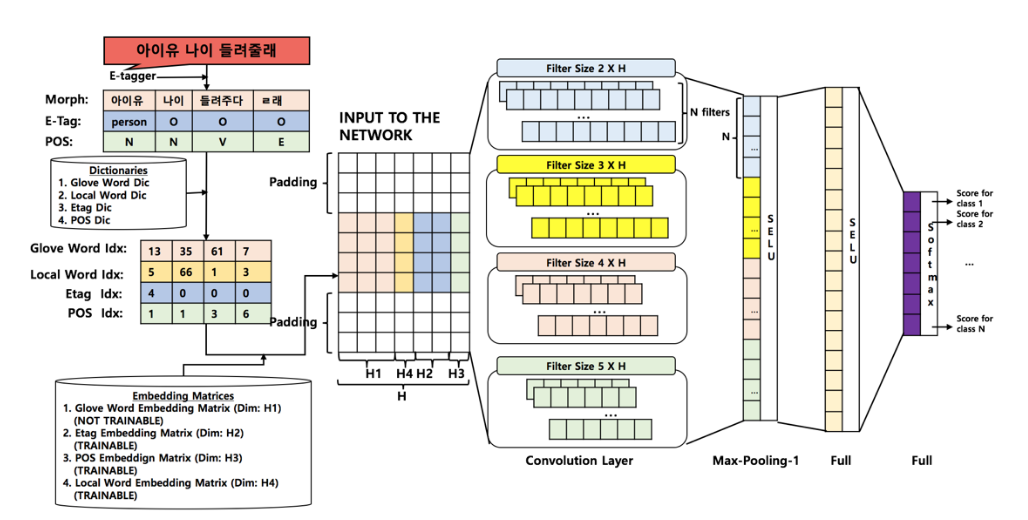

카카오미니에서 명령어의 의도를 분석하는 방법을 다룬 글입니다. 우선 문장을 벡터로 변환합니다. 그다음 딥러닝 CNN 모델을 사용하여 특정 카테고리로 분류한다고 합니다.

워드 임베딩은 GloVe를 기반으로 합니다. 여기에 몇 가지 추가 벡터를 삽입하였습니다.

첫째, Local Word 벡터입니다. 같은 단어라도 문맥에 따라 의미가 달라집니다. 예를 들어, 카카오는 회사의 명칭, 건물 장소, 음식 등 다양한 뜻을 내포합니다. 이런 의미 벡터를 따로 Glove 벡터에 더합니다.

둘째, 엔티티 벡터입니다. '아이유 좋은 날'이란 문장에서, '아이유'는 인물이고 '좋은 날'은 곡명이란 개체입니다. 임베딩에 엔티티 정보를 같이 넣어서 단어의 뜻을 더 명확히 합니다.

셋째, 품사정보인 POS 벡터입니다. 명사, 동사, 형용사 같은 품사 벡터를 추가해서 문장의 의미를 더욱 잘 파악하도록 하였습니다.