- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

글 수 284

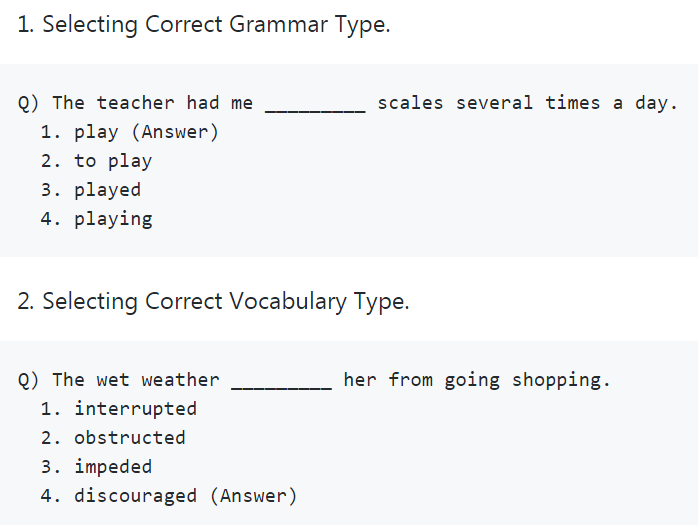

BERT로 토익 문제를 푸는 프로젝트입니다. 따로 토익문제 데이터로 훈련하지 않고, 사전훈련된 모델을 그냥 사용했습니다. 그런데도 70%의 정확도를 보인다고 합니다.

BERT는 기본적으로 두 가지 방법으로 학습을 합니다. 하나는 문장의 특정 단어를 마스킹으로 가리고 그 단어를 예측합니다. 두 번째는 두 문장이 입력으로 들어가면 서로 연결되는 의미인지 T/F로 판단합니다.

토익 문제를 풀기 위해서는 마스킹 방식의 BertForMaskedLM 모델을 바로 적용할 수 있습니다. 4가지의 예제 단어를 라벨로 하여 각각 모델의 예측값(얼마나 정확한지를 나타내는 loss)를 얻습니다. 그리고 손실오차가 가장 작은 단어를 정답으로 판단합니다.

앞으로 딥러닝 자연어처리를 기반으로 한 재미있는 프로젝트들이 더 많아질 것 같습니다.