- AI Dev - 인공지능 개발자 모임

- 정보공유

- 머신러닝

글 수 35

http://fermium.tistory.com/833

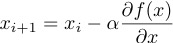

경사 하강법(Gradient Descent)은 기울기로 함수의 최소값을 찾는 방법입니다.

많은 알고리즘에서 사용되는데 특히 신경망의 오류역전파에서 오류의 최소값을 찾는데 쓰입니다.

위의 f(x)라는 2차함수가 있을때 가장 낮은 곳에 위치하는 x값을 찾는다고 생각해봅시다.

현재 위치에서 계속 아래 방향으로 반복적으로 이동한다면 원하는 값을 얻을 수 있습니다.

그러면 어떻게 아래 방향으로 움직일 수 있을까요.

바로 접선의 기울기인 함수의 미분을 사용하면 가능합니다.

알파는 학습계수(0~1)인데 작을 수록 정확하지만 시간이 오래 걸립니다.

현재 x에서 함수의 기울기에 학습계수만큼 곱해 x를 조금씩 이동합니다.

이렇게 반복해서 x를 계산하면 최종적으로 가장 낮은 위치의 x값에 수렴합니다.

< 인공지능 개발자 모임 >

- 페이스북 그룹에 가입하시면 인공지능에 대한 최신 정보를 쉽게 받으실 수 있습니다.

- https://www.facebook.com/groups/AIDevKr/