- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

https://uwnlp.github.io/event2mind/

어제 삼성 AI 포럼 Day2에 참가를 했었는데 거기서 워싱턴대 최예진 교수의 발표가 있었습니다. 그중에서 Event2Mind라는 것에 관심이 생겨서 논문을 읽어봤습니다.

범용적인 인공지능이나 자연어처리를 구현하기 어려운 가장 큰 이유 중 하나는 상식을 알고리즘으로 표현하고 추론하기가 쉽지 않기 때문입니다. 예를 들어, "다이어트 중인데 배가 너무 고프다"라고 말하면 "칼로리가 적은 닭가슴살 샐러드는 어떠세요?"라고 대답하는 챗봇은 다음과 같은 상식들을 알고 있어야 합니다.

배가 고픔 -> 음식을 먹어야 됨

다이어트 -> 칼로리가 낮은 음식 섭취

닭가슴살 샐러드 -> 칼로리가 낮음

그리고 추론을 합니다.

배가 고픔 -> 음식을 먹어야 됨 -> (조건: 다이어트) 칼로리가 낮은 음식 섭취 -> 닭가슴살 샐러드 선택

현재 대부분의 챗봇들은 이런 과정을 각각 별도로 프로그래머가 구현을 합니다. 상황에 맞게 따로 룰을 만드는 것도 어렵고 조건이 많을수록 룰도 복잡해기기 때문에 범용적으로 활용하기가 불가능합니다.

다이어트(entity) 중인데 배가 너무 고프다(식사 intent)

if intent == "식사" then

if "다이어트" in entity then 닭가슴살 샐러드 추천

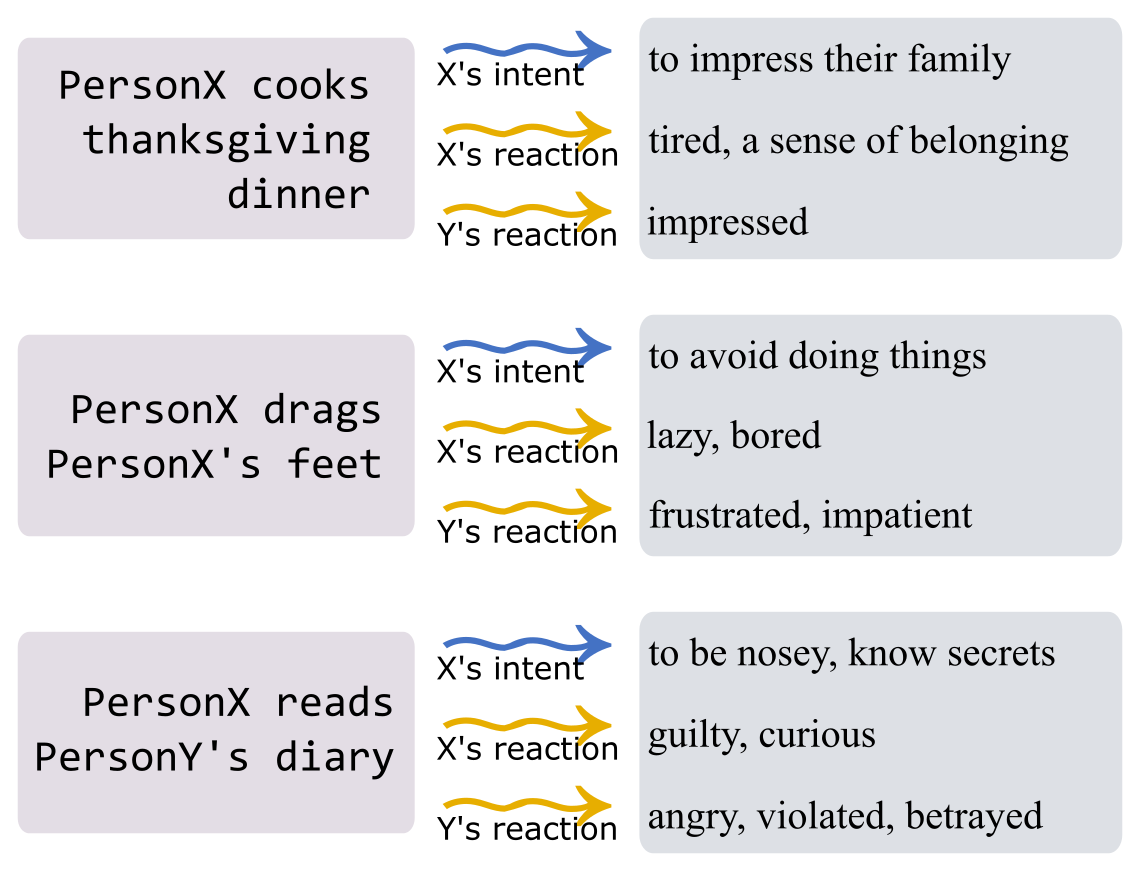

지금까지는 기호처리를 통해 상식을 구축하려는 시도가 많았는데 최근에는 딥러닝으로 학습하는 방법이 많이 연구되고 있습니다. Event2Mind는 문장이 주어졌을때 그 의도와 감정 리액션을 단어들로 해석합니다.

PersonX cooks thanksgiving dinner

-> X's intent : to impress their family

-> X's reaction : tired, a sense of belonging

-> Y's reaction : impressed

이를 구현하기 위해 먼저 크라우드소싱을 통해 사람이 각 문장에 대한 intent와 reaction 단어들을 직접 작성합니다. 그리고 word embedding과 RNN 같은 기법을 사용하여 학습을 하였다고 합니다. 이런 학습 방법의 장점은 데이터에 없는 문장에도 그럴듯한 대답이 나온다는 것입니다.

아직 이런 결과를 다양한 목적에 적용하기는 어려울 것 같지만 앞으로 계속 발전할거라 생각됩니다. 링크 페이지의 하단에서 다양한 문장들에 대해서 테스트를 해보실 수 있습니다.