- AI Dev - 인공지능 개발자 모임

- 정보공유

- 챗봇 딥러닝

https://arxiv.org/pdf/1704.00051.pdf

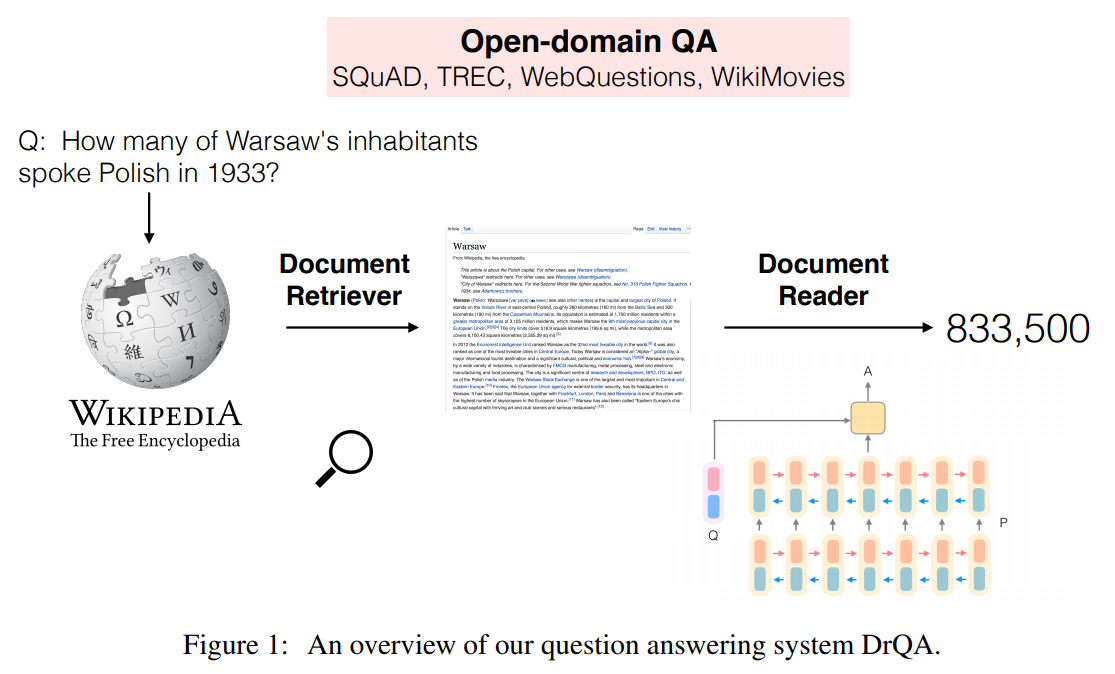

요즘 질의응답 시스템에 관심이 생겨서 계속 찾아보고 있습니다. 이번 논문은 2017년 페이스북에서 발표한 DrQA입니다. 위키피디아를 검색하여 질문에 대한 정답을 출력합니다.

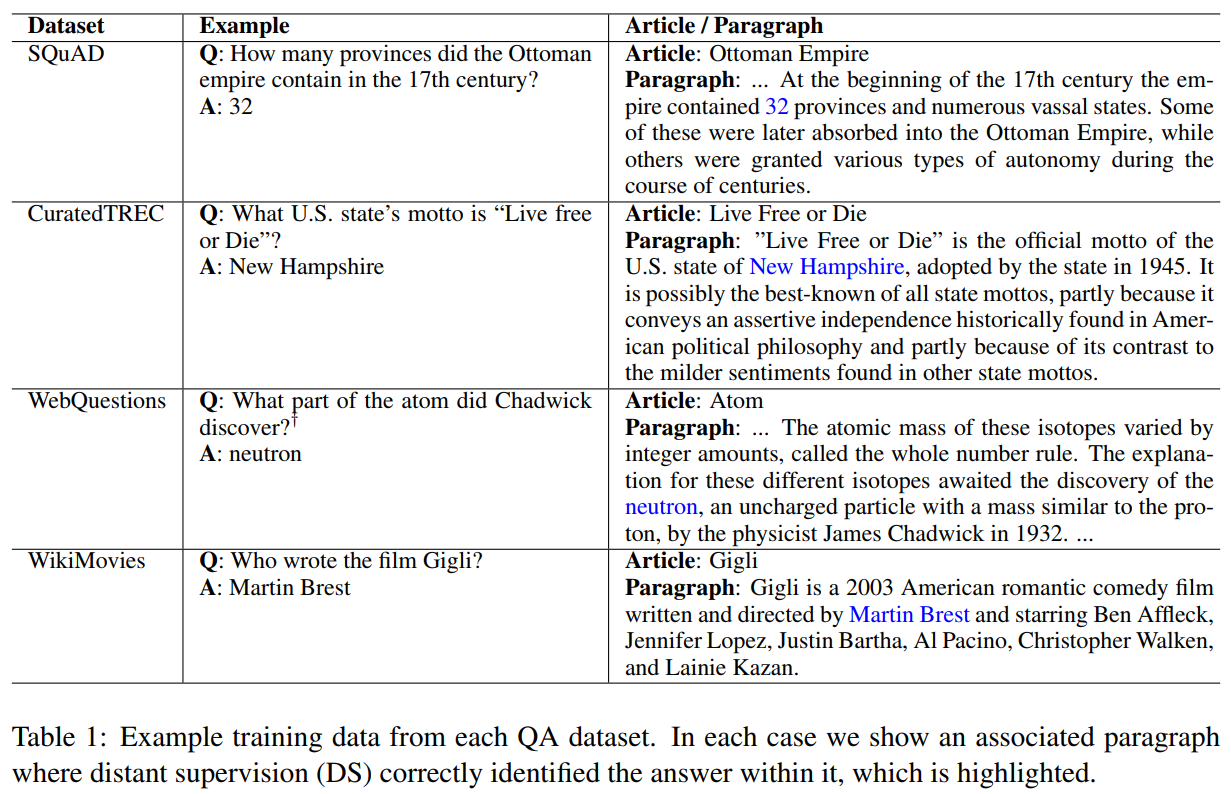

예를 들어, "한국의 수도는?"이라고 질문을 하였습니다. 먼저 BoW(Bag of Words)로 문장을 벡터로 변환합니다. 전체 위키 문서에서 (미국, 한국, 크기, 역사, 수도)의 5개의 단어만 있다면 가정하겠습니다. 각 단어의 위치에 출현한 개수를 넣으면 (0, 1, 0, 0, 1)가 됩니다. 좀 더 정확도를 높이기 위해 TF-IDF를 적용하면 (0, 0.9, 0, 0, 0.7) 같이 바뀝니다. 다른 문서에서 자주 나오는 단어는 중요도를 낮추는 방법입니다.

또한 단어의 순서를 고려하기 위해 BoW가 바이그램(bigram)으로 되어있습니다. 단어 하나가 아니라 연속된 두 단어를 묶어서 최소 단위로 지정합니다. 위키의 전체 데이터는 이미 바이그램 TF-IDF로 만들어져 있습니다. 그다음 질문의 벡터와 각 문서 벡터의 코사인 유사도를 구합니다. 여기서 가장 점수가 높은 5개의 문서를 뽑습니다.

여기까지가 Document Retriever이고 이제 Document Reader를 수행합니다. 5개의 후보 문서를 각각 질문과 함께 입력하여 문서안에 있는 정답을 찾습니다. 5개의 결과 중 가장 정확도가 높은 것을 선택합니다. 트랜스포머와 버트가 나오기 전이라 딥러닝 모델은 LSTM으로 구현되었습니다.