글 수 13

오류 역전파 설명

-> http://llnntms.tistory.com/31

오류 역전파 C++ 코드

-> http://hub-ai.com/annhmmcrt/17009

오류 역전파(Back Propagation)은 신경망 학습의 가장 대표적인 학습방법 입니다.

기본적인 아이디어는 실제 출력과 목표 출력의 차이인 오차가 낮아지도록 가중치를 수정하는 것입니다.

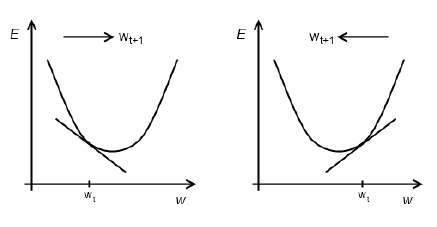

위의 그림처럼 가중치(w)와 오차(E)가 함수로 주어졌을때

경사 하강법을 사용하여 오차가 가장 낮아지는 신경망의 가중치를 찾는 것이 목표입니다.

아래 링크는 경사 하강법에 대한 자세한 설명입니다.

http://aidev.co.kr/bigdata/806

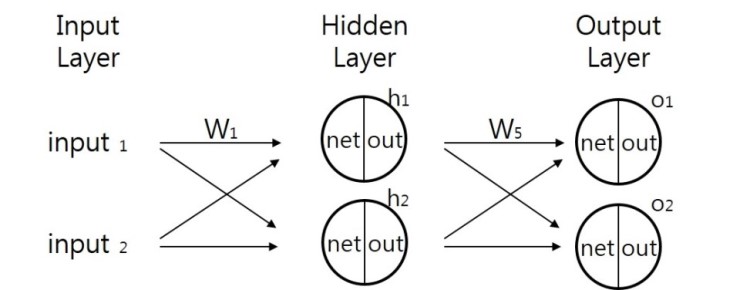

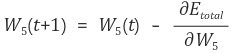

위와 같은 신경망에서 오류 역전파로 가중치 w5 를 구하는 공식은 아래와 같습니다.

경사 하강법으로 오류를 가중치로 미분하면서 가중치를 조정합니다.

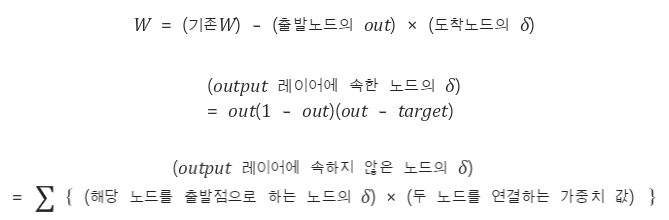

그 다음 수식 계산이 복잡한데 최종적으로 나오는 결과는 아래와 같습니다.

상단 링크에 있는 C++ 코드와 위의 수식을 비교해 보시길 바랍니다.

< 인공지능 개발자 모임 >

- 페이스북 그룹에 가입하시면 인공지능에 대한 최신 정보를 쉽게 받으실 수 있습니다.

- https://www.facebook.com/groups/AIDevKr/